LINUX ИпПЩгУШКМЏжЎ Corosync

ЪБМф:2014-12-01 01:51 РДдД:linux.it.net.cn зїеп:IT

CorosyncЃКЫќЪєгкOpenAIS(ПЊЗХЪНгІгУНгПкЙцЗЖ)жаЕФвЛИіЯюФПcorosyncвЛАцБОжаБОЩэВЛОп БИЭЖЦБЙІФмЃЌЕНСЫcorosync 2.0жЎКѓв§ШыСЫvotequorumзгЯЕЭГвВОпБИСЫЭЖЦБЙІФмСЫЃЌШчЙћЮвУЧгУЕФЪЧ1АцБОЕФЃЌгжашвЊгУЕНЦБЪ§зіОіВпЪБФЧИУШчКЮЪЧКУФиЃЛЕБШЛЃЌдкКьУБЩЯАб cman + corosyncНсКЯЦ№РДгУЃЌЕЋЪЧдчЦкcmanИњpacemakerУЛЗЈНсКЯЦ№РДЃЌШчЙћЯыгУpacemakerгжЯыгУЭЖЦБЙІФмЕФЛАЃЌФЧОЭАбcmanЕБГЩ corosyncЕФВхМўРДгУЃЌАбcmanЕБГЩcorodyncЕФЭЖЦБЙІФмЃЌЕБШЛЃЌетРяНсКЯСЫСНИіСЫMessaging LaderЃЛCorosyncФПЧАгаСНИіжїСїЕФАцБОЃКвЛИіЪЧ2ЯЕСаЕФЃЌСэвЛИіЪЧ1ЯЕСаЕФЮШЖЈАцЃЛ2АцБОКЭ1АцБОВюБ№КмДѓЃЌ1АцБОВЛОпгаЭЖЦБЙІФмЃЌ2АцБОжЎ Кѓв§ШыСЫvotequorumКѓжЇГжЭЖЦБЙІФмСЫЃЛOpenAISздДгЕЎЩњжЎКѓЃЌКьУБОЭЛљгкетИіЙцЗЖбаЗЂСЫвЛИіИпПЩгУМЏШКЕФНтОіЗНАИНаcmanЃЌВЂЮЊcmanЬсЙЉСЫrgmangaerзїЮЊзЪдДЙмРэЦїЃЌВЂЧвШнКЯcongaШЋЩњУќжмЦкЕФЙмРэНгПкаЮГЩСЫRHCSЃЛ

ConrosyncЪЧДгOpenAISетИіДѓЯюФПжаЗжжЇГіРДЕФвЛИіЯюФПЃЌЖјPacemakerЪЧheartbeat v3АцБОжаЗжСбГіРДзЈУХгУгкЬсЙЉИпПЩгУМЏШКCRMЕФзщМўЃЌЙІФмЪЎЗжЧПДѓЃЌ CoreosyncдкДЋЕнаХЯЂЕФЪБКђПЩвдЭЈЙ§вЛИіМђЕЅЕФХфжУЮФМўРДЖЈвхаХЯЂДЋЕнЕФЗНЪНКЭавщЕШЃЌCorosyncПЩвдЬсЙЉвЛИіЭъећЕФHAЙІ ФмЃЌCorosyncЪЧЮДРДЕФЗЂеЙЗНЯђЃЌдквдКѓЕФаТЯюФПРяЃЌвЛАуВЩгУCorosyncЃЌЖјheartbeat_guiПЩвдЬсЙЉКмКУЕФHAЙмРэЙІФмЃЌПЩвдЪЕ ЯжЭМаЮЛЏЕФЙмРэЁЃ

PacemakerЪЧвЛИіМЏШКЙмРэЦїЁЃЫќРћгУЪзбЁМЏШКЛљДЁЩшЪЉЃЈOpenAIS ЛђheartbeatЃЉЬсЙЉЕФЯћЯЂКЭГЩдБФмСІЃЌгЩИЈжњНкЕуКЭЯЕЭГНјааЙЪеЯМьВтКЭЛиЪеЃЌЪЕЯжадШКМЏЗўЮёЃЈврГЦзЪдДЃЉЕФИпПЩгУадЁЃ

corosync+pacemakerЃКдкХфжУcorosyncЪБзюКУОпгаШ§ИівдЩЯЕФНкЕуЃЌВЂЧвНкЕуИіЪ§ЮЊЦцЪ§ИіЃЌШчЙћЪЙгУХМЪ§ИіНкЕуЕФЛАвВУЛЙиЯЕЃЌжЛЪЧвЊЙиБеВЛОпгаЗЈЖЈЦБЪ§ЕФОіВпВпТдЙІФмЃЛ

ЪЕЯжЙ§ГЬЃК

1ЁЂЫЋЛњЛЅаХашвЊЩшжУКУЃЌhostsЮФМўашвЊНтЮіКУЃЌЪБМфвЊЭЌВН

# vim /etc/hosts

172.16.27.1 node1.tanxw.com

172.16.27.2 node2.tanxw.com

# ssh-keygen -t rsa -P ‘’

# ssh-copy-id -i id_rsa.pub node2.tanxw.com

2ЁЂАВзАcorosyncЃЌетРяЮвУЧгУansibleРДАВзАЃЌвЊЪЙгУansibleдквЛЬЈжїЛњЩЯВйзїЖрЬЈжїЛњЕУашвЊЪТЯШАВзАansibleЃЌФЧетРяЮвУЧ ОЭЯШЫЕЫЕАВзАКЭХфжУЪЙгУansibleЃЌАВзАansibleвВПЩвдгУyumРДАВзАЃЌВЛЙ§ашвЊНтОівРРЕЙиЯЕЃК

# yum -y install python-jinja2 НтОівРРЕЙиЯЕ

# yum -y install ansible

АВзАКУжЎКѓдйШЅ/etc/ansibleЯТХфжУСНИіНкЕуЕФhostnameЃК

# vim /etc/ansible/hosts АбРяУцЕФФкШнШЋЖМзЂЪЭЕєЃЌМгЯТУцФуЕФНкЕуhostname

[corosync]

node1.tanxw.com

node2.tanxw.com

БЃДцЭЫГіЃЁ

ЮвУЧетРяЪЙгУ172.16.27.0етЬЈжїЛњАВзАansibleЃЌВйзї172.16.27.1КЭ.2етСНЬЈжїЛњЃЌВтЪдвЛЯТЃК

# yum -y install python-jinja2 НтОівРРЕЙиЯЕ

# yum -y install ansible

АВзАКУжЎКѓдйШЅ/etc/ansibleЯТХфжУСНИіНкЕуЕФhostnameЃК

# vim /etc/ansible/hosts АбРяУцЕФФкШнШЋЖМзЂЪЭЕєЃЌМгЯТУцФуЕФНкЕуhostname

[corosync]

node1.tanxw.com

node2.tanxw.com

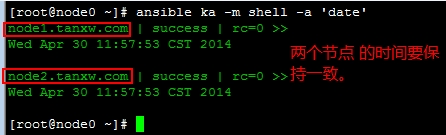

3ЁЂЪБМфЭЌВНЃЌашвЊЪТЯШХфжУКУвЛЬЈЪБМфЗўЮёЦїЃЌШЛКѓдкcrontab -eжаЪфШыЃК

# crontab -e

*/5 * * * * /usr/sbin/ntpdte 172.16.27.0 &> /dev/null БэЪОУПИє5ЗжжгЭЌВНвЛДЮ

КУЃЌзМБИЙЄзїзіКУСЫжЎКѓОЭПЩвдАВзАcorosyncСЫЃЌЪЙгУansibleВщПДСНИіНкЕуЪЧЗёвбОАВзАСЫcorosyncЃК

[root@node0 ~]# ansible corosync -m shell -a 'rpm -q corosync'

node2.tanxw.com | FAILED | rc=1 >>

package corosync is not installed

node1.tanxw.com | FAILED | rc=1 >>

package corosync is not installed

# ansible corosync -m yum -a "name=corosync state=present" ШЋВПЪфГіЯдЪОЮЊТЬЩЋЫЕУїАВзАГЩЙІ

[root@node0 ~]# ansible corosync -m shell -a 'rpm -q corosync' дйВщПДвЛЯТcorosyncЕФАВзААцБО

node2.tanxw.com | success | rc=0 >>

corosync-1.4.1-17.el6.x86_64

node1.tanxw.com | success | rc=0 >>

corosync-1.4.1-17.el6.x86_64

# cp /etc/corosync/corosync.conf.example /etc/corosync.conf ИДжЦвЛЗнcorosyncЕФбљБОХфжУЮФМў

# vim /etc/corosync/corosync.conf БрМХфжУЮФМўаоИФШчЯТФкШн

compatibility: whitetank #етИіБэЪОЪЧЗёМцШн0.8жЎЧАЕФАцБО

totem { #ЭМЬкЃЌетЪЧгУРДЖЈвхМЏШКжаИїНкЕужаЪЧдѕУДЭЈаХЕФвдМАВЮЪ§

version: 2 #ЭМЬкЕФавщАцБОЃЌЫќЪЧжжавщЃЌавщЪЧгаАцБОЕФЃЌЫќЪЧгУгкИїНкЕуЛЅЯрЭЈаХЕФавщЃЌетЪЧЖЈвхАцБОЕФ

secauth: on #БэЪОАВШЋШЯжЄЙІФмЪЧЗёЦєгУЕФ

threads: 0 #ЪЕЯжШЯжЄЪБЕФВЂааЯпГЬЪ§ЃЌ0БэЪОФЌШЯХфжУ

interface { # жИЖЈдкФФИіНгПкЩЯЗЂаФЬјаХЯЂЕФЃЌЫќЪЧИізгФЃПщ

ringnumber: 0 #ЛЗКХТыЃЌМЏШКжагаЖрИіНкЕуЃЌУПИіНкЕуЩЯгаЖрИіЭјПЈЃЌБ№ЕФНкЕуПЩвдНгЪеЃЌЭЌЪБЮвУЧБОЛњЕФБ№вЛПщЭјПЈвВПЩвдНгЪеЃЌЮЊСЫБмУтетаЉаХЯЂдкетбљЕФЛЗзДЗЂЫЭЃЌвђДЫвЊЮЊетИіЭјПЈЖЈвхвЛИіЮЈвЛЕФЛЗКХТыЃЌвдБмУтаФЬјаХЯЂЛЗЗЂЫЭЁЃ

bindnetaddr: 192.168.1.1 # АѓЖЈЕФЭјТчЕижЗ

mcastaddr: 226.94.1.1 #ЖрВЅЕижЗЃЌвЛЖдЖрЭЈаХ

mcastport: 5405 # ЖрВЅЖЫПк

ttl: 1 # БэЪОжЛЯђЭтВЅвЛДЮ

}

}

logging { # ИњШежОЯрЙи

fileline: off

to_stderr: no # БэЪОЪЧЗёашвЊЗЂЫЭЕНДэЮѓЪфГі

to_logfile: yes #ЪЧВЛЪЧЫЭИјШежОЮФМў

to_syslog: no #ЪЧВЛЪЧЫЭИјЯЕЭГШежО

logfile: /var/log/cluster/corosync.log #ШежОЮФМўТЗОЖ

debug: off #ЪЧЗёЦєЖЏЕїЪд

timestamp: on #ШежОЪЧЗёашвЊМЧТМЪБМфДС

logger_subsys { #ШежОЕФзгЯЕЭГ

subsys: AMF

debug: off

}

}

amf { # ИњБрГЬНгПкЯрЙиЕФ

mode: disabled

}

service { #ЖЈвхвЛИіЗўЮёРДЦєЖЏpacemaker

ver: 0 #ЖЈвхАцБО

name: pacemaker #етИіБэЪОЦєЖЏcorosyncЪБЛсздЖЏЦєЖЏpacemaker

}

aisexec { #БэЪОЦєЖЏaisЕФЙІФмЪБвдФФИігУЛЇЕФЩэЗнШЅдЫааЕФ

user: root

group: root #ЦфЪЕетИіПщЖЈвхВЛЖЈвхЖМПЩвдЃЌcorosyncФЌШЯОЭЪЧвдrootЩэЗнШЅдЫааЕФ

}

етРяЮвУЧИФвЛИіЫцЛњЪ§ЩЪГиЃЌдйАбХфжУКУЕФcorosyncЕФХфжУКЭШЯжЄЮФМўИДжЦЕНСэвЛИіНкЕуЩЯШЅЃК

# mv /dev/random /dev/m

# ln /dev/urandom /dev/random ШчЙћетАбетИіЫцЛњЪ§ЩЪГиИФСЫПЩвдЛсВњЩњЫцЛњЪ§ВЛЙЛгУЃЌетИіОЭвЊЧУЛїМќХЬИјетИіЩЪГивЛаЉЫцЛњЪ§ЃЛЩњГЩЭъетИіkeyКѓАбСДНгЩОГ§ЃЌдйАбЩЪГиИФЛиРДЃЛВЛЙ§етбљИФПЩвдЛсгаЕуЮЊАВШЋЃЌВЛЙ§зіВтЪдЕФгІИУВЛвЊНєЃЛ

# corosync-keygen

# rm -rf /dev/random

# mv /dev/m /dev/random

ЖдгкcorosyncЖјбдЃЌЮвУЧИїНкЕужЎМфЭЈаХЪББиаывЊФмЙЛЪЕЯжАВШЋШЯжЄЕФЃЌвЊгУЕНвЛИіУмдПЮФМўЃК

# corosync-keygen # ЩњГЩУмдПЮФМўЃЌгУгкЫЋЛњЭЈаХЛЅаХЃЌЛсЩњГЩвЛauthkeyЕФЮФМў

# scp authkey corosync.conf node2.tanxw.com:/etc/corosync/ дкХфжУКУЕФНкЕуЩЯАбетСНИіЮФМўИДжЦИјСэвЛИіНкЕуЩЯЕФcorosyncЕФХфжУЮФМўжаШЅ

АВзАpacemaker

# ansible corosync -m yum -a “name=pacemaker state=present”

ЮвУЧвЊЯыЪЙгУpacemakerХфжУЕФЛАашвЊАВзАвЛИіpacemakerЕФНгПкЃЌЫќЕФетИіГЬађЕФНгПкНаcrmshellЃЌЫќдкаТАцБОЕФ pacemakerвбОБЛЖРСЂГіРДСЫЃЌВЛдйЪЧpacemakerЕФзщГЩВПЗжСЫЃЌдчЦкзАЩЯpacemakerОЭЛсздДјгаcrmshellЃЌвђДЫвЊЯыгУ crmshellЕФЛАЕУШЅАВзАcrmshellЃЌЖјАВзАcrmshellгжвРРЕгкpsshЕФЯрЙиАќЃЌвђДЫЕУАВзАетСНИізщМўЃЌ(етРяЕФетСНИіАќЪЧздМКжЦМў ЕФ)ЃЌФФИіНкЕуХфжУОЭАВзАдкФФИіНкЕуЩЯОЭПЩвдСЫЃЌвВЮоашСНИіНкЕуЖМАВзАетСНИіАќЃК

crmsh-1.2.6-4.el6.x86_64.rpm

pssh-2.3.1-2.el6.x86_64.rpm

# yum -y install crmsh-1.2.6-4.el6.x86_64.rpm pssh-2.3.1-2.el6.x86_64.rpm

вЛЧаЖМOKСЫжЎКѓОЭПЩвдЦєЖЏЗўЮёСЫЃЌСНИіНкЕуЖМашвЊЦєЖЏЃК

дкетРяcrmЪЧвЛИіКмИДдгЕФУќСюЃЌПЩвддкУќСюаажБНгЪфШыcrmНјШыcrmЕФУќСюааФЃЪНЃК# crm

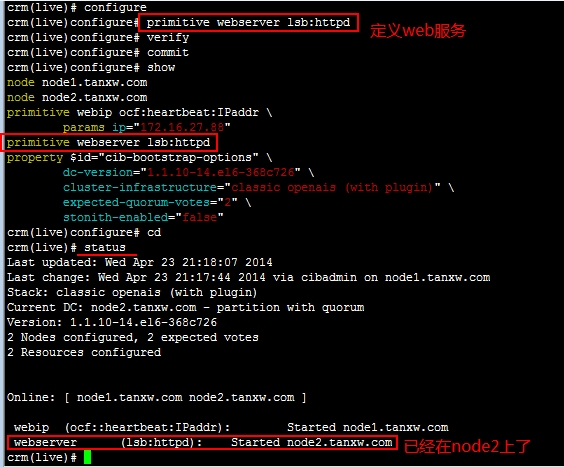

ФЧдкетРяЃЌЮвУЧШчКЮШЅХфжУвЛИізЪдДФиЃЌЫфШЛЫќИњheartbeatТдгаЧјБ№ЃЌЕЋЪЧИХФюЛљБОЩЯЪЧвЛбљЕФЃЌЯТУцЮвУЧОЭРДХфжУвЛИіwebзЪдДАЩЃЁ

гЩгкЮвУЧЕФcorosyncФЌШЯЪЧЦєгУstonithЙІФмЕФЃЌЕЋЪЧЮвУЧетРяУЛгаstonithЩшБИЃЌШчЙћЮвУЧжБНгШЅХфжУзЪдДЕФЛАЃЌгЩгкУЛга stonithЙІФмЃЌЫљвдзЪдДЕФЧаЛЛВЂВЛЛсЭъГЩЃЌЫљвдвЊНћгУstonithЙІФмЃЌЕЋНћгУstonoithашвЊЮвУЧШЅХфжУМЏШКЕФШЋОжstonithЪєадЃЌШЋ ОжЪєадЪЧЖдЫљгаЕФНкЕуЖМЩњаЇЃЛ

[root@node1 corosync]# crm configure #НјШыcrmУќСюааФЃЪНХфжУзЪдДЕШ

crm(live)configure# property #ЧаЛЛЕНpropertyФПТМЯТЃЌПЩвдгУСНДЮtabМќНјааВЙШЋКЭВщПД

usage: property [$id=<set_id>] <option>=<value> # propertyЕФгУЗЈКЭИёЪН

crm(live)configure# property stonith-enabled=false #НћгУstonith-enabled

crm(live)configure# verify #МьВщЩшжУЕФЪєадЪЧЗёе§ШЗ

crm(live)configure# commit #МьВщУЛЮЪЬтОЭПЩвдЬсНЛСЫ

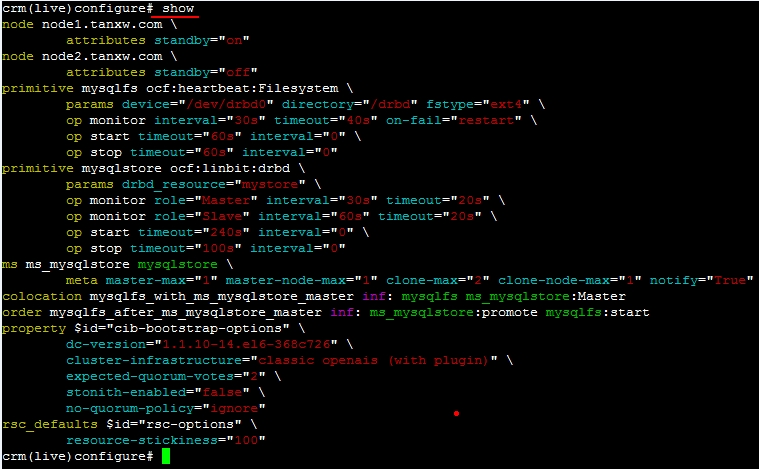

crm(live)configure# show #ВщПДЕБЧАМЏШКЕФЫљгаХфжУаХЯЂ

node node1.tanxw.com

node node2.tanxw.com #СНИіНкЕу

property $id="cib-bootstrap-options" \

dc-version="1.1.10-14.el6-368c726" \ #DCЕФАцБОКХ

cluster-infrastructure="classic openais (with plugin)" \ #МЏШКЕФЛљДЁМмЙЙЃЌЪЙгУЕФЪЧOpenAISЃЌВхМўЪНЕФ

expected-quorum-votes="2" \ #ЦкЭћНкЕуЕФЦБЪ§

stonith-enabled="false" #НћгУstonithЙІФм

crm(live)configure#

ВщПДвЛЯТНкЕуЕФдЫаазДЬЌЃК

вЊзЂвтЃКШчЙћвЛИіНкЕуЙвСЫЃЌОЭВЛгЕгаЗЈЖЈЦБЪ§СЫЃЌФЧзЪдДЪЧВЛЛсЧаЛЛЕФ

МЏШКЕФВпТдгаМИжжЃК

stopped ЃКЭЃжЙЗўЮё

ignore ЃККіТдЃЌМЬајдЫаа

freeze ЃКЖГНсЃЌвбОСЌНгЕФЧыЧѓМЬајЯьгІЃЌаТЕФЧыЧѓВЛдйЯьгІ

suicide ЃКздЩБЃЌНЋЗўЮёkillЕє

дйНјШыcrmЖЈвхЮвУЧЫљашвЊЕФзЪдДАЩЃЁ

crm(live)# configure

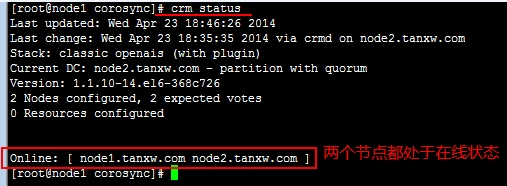

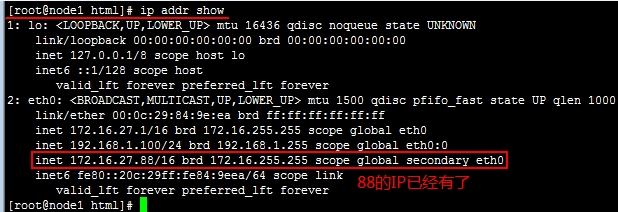

crm(live)configure# primitive webip ocf:heartbeat:IPaddr params ip=172.16.27.88

crm(live)configure# verify

crm(live)configure# commit

crm(live)configure# show

node node1.tanxw.com

node node2.tanxw.com

primitive webip ocf:heartbeat:IPaddr \

params ip="172.16.27.88"

property $id="cib-bootstrap-options" \

dc-version="1.1.10-14.el6-368c726" \

cluster-infrastructure="classic openais (with plugin)" \

expected-quorum-votes="2" \

stonith-enabled="false"

crm(live)configure#

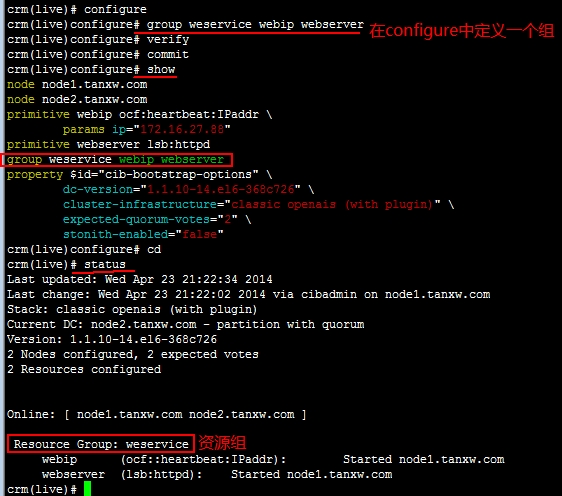

ЖЈвхвЛИізщЃЌАбжЎКѓЖЈвхЕФзЪдДМгЕНетИізщРяУцШЅЃК

# group weservice webip webserver

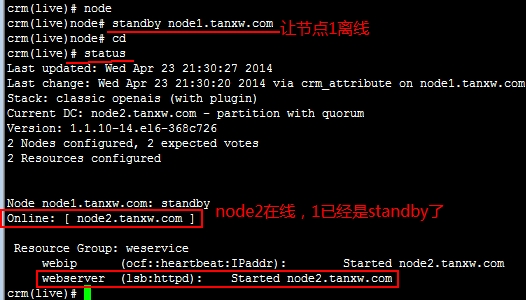

ШУnode1НкЕуРыЯпЃК

КУСЫЃЌетжжЙІФмЮвУЧвВЭъГЩСЫЃЌШчЙћШУnode1ЩЯЯпЫќвВВЛЛсзЊЛиЕФЃЌвђЮЊЮвУЧУЛгаЖЈвхЫќЕФЧуЯђадКЭЙЪеЯзЊЛиЃЌЫљвдnode1ЛиРДОЭЛиРДАЩЃЌЖјЗўЮёвРШЛдЫаадкnode2ЩЯЃЛ

crm(live)node# online node1.tanxw.com ШУnode1ДгаТЩЯЯп

DRBD (Distributed Replicated Block Device)ЗжВМЪНИДжЦПщЩшБИЃЌЫќЪЧ Linux ЦНЬЈЩЯЕФЗжЩЂЪНДЂДцЯЕЭГЃЌЭЈГЃгУгкИпПЩгУадЃЈhigh availability, HAЃЉМЏШКжаЁЃDRBD РрЫЦДХХЬеѓСаЕФRAID 1ЃЈОЕЯёЃЉЃЌжЛВЛЙ§ RAID 1 ЪЧдкЭЌвЛЬЈЕчФдФкЃЌЖј DRBD ЪЧЭИЙ§ЭјТчЁЃ

DRBD ResourceЃКDRBDЫљОпгаЕФМИжжЪєадЃК

resource nameЃКПЩвдЪЙгУГ§ПеАззжЗћЭтЕФШЮвтACSIIБэжаЕФзжЗћЃЛ

drbdЩшБИЃКdrbdЕФЩшБИЕФЗУЮЪТЗОЖЃЌЩшБИЮФМў/dev/drbd#ЃЛ

diskЃКИїНкЕуЮЊзщГЩДЫdrbdЩшБИЫљЬсЙЉЕФПщЩшБИЃЌЭЈГЃЪЧвЛИіДХХЬЗжЧјЃЛ

ЭјТчЪєадЃКНкЕуМфЮЊСЫЪЕЯжПчжїЛњДХХЬОЕЯёЖјЪЙгУЕФЭјТчХфжУЃЛ

зЂвтЃКгУЛЇПеМфЙЄОпгыdrdbгыФкКЫжаЪЙгУЕФФЃПщАцБОвЊБЃГжвЛжТЃЌжЛгадкЪЙгУdrbdadmЙЄОпЪБВХЛсЖСШЁХфжУЮФМўЃЌЖдЖрИізЪдДЕФЙЋЙВХфжУЃЌПЩвдЬсШЁГіРДжЛХфжУвЛДЮЃЌЭЈГЃБЃДцдкCommonжаЃЌДЫЭтЛЙгаglobalХфжУЃЌетжжХфжУИњзЪдДБОЩэУЛгаЙиЯЕЕФЃЛ

drbdЕФзщГЩВПЗжЃКЕквЛВПЗжгУЛЇПеМфЙЄОпЃЛЕкЖўВПЗжЪЧФкКЫФЃПщ(дк2.6.33МАвдКѓАцБОЕФФкКЫжБНгдкФкКЫжаОЭгаСЫ)

гУЛЇПеМфЙЄОпЃКИњФкКЫАцБОЙиЯЕБШНЯЫЩЩЂЃЌжЛвЊЪЧФмЪЪгУгкCentOS 6МАЖдгІгВМўЦНЬЈЕФОЭOK;

ФкКЫФЃПщЃКБиаыгыЕБЯТФкКЫАцБОбЯИёЖдгІЃЛЦфжаdrbdФкКЫФЃПщДњТывбОећКЯНјLinuxФкКЫ2.6.33вдКѓЕФАцБОжаЃЌвђДЫЃЌШчЙћФњЕФФкКЫАцБОИпгкДЫАцБОЕФЛАЃЌФужЛашвЊАВзАЙмРэЙЄОпМДПЩЃЛЗёдђЃЌФњашвЊЭЌЪБАВзАФкКЫФЃПщКЭЙмРэЙЄОпСНИіШэМўАќЃЌВЂЧвДЫСНепЕФАцБОКХвЛЖЈвЊБЃГжЖдгІЁЃ

НјГЬМфЭЈаХЕФШ§жжЗНЪНЃКЯћЯЂађСаЁЂЦьгяМАЙВЯэФкДц:

ЪВУДЪЧЯћЯЂЖгСаЃК

ЯћЯЂБЛЗЂЫЭЕНЖгСажаЃЌ"ЯћЯЂЖгСа"ЪЧдкЯћЯЂЕФДЋЪфЙ§ГЬжаБЃДцЯћЯЂЕФШнЦїЁЃЯћЯЂЖгСаЙмРэЦїдкНЋЯћЯЂДгЫќЕФдДжаМЬЕНЫќЕФФПБъЪБГфЕБжаМфШЫЁЃЖгСаЕФжївЊФПЕФЪЧ ЬсЙЉТЗгЩВЂБЃжЄЯћЯЂЕФДЋЕнЃЛШчЙћЗЂЫЭЯћЯЂЪБНгЪеепВЛПЩгУЃЌЯћЯЂЖгСаЛсБЃСєЯћЯЂЃЌжБЕНПЩвдГЩЙІЕиДЋЕнЫќ;ЯћЯЂЖгСаОЭЪЧвЛИіЯћЯЂЕФСДБэЁЃПЩвдАбЯћЯЂПДзївЛИіМЧ ТМЃЌОпгаЬиЖЈЕФИёЪНвдМАЬиЖЈЕФгХЯШМЖЁЃЖдЯћЯЂЖгСагааДШЈЯоЕФНјГЬПЩвдЯђЯћЯЂЖгСажаАДеевЛЖЈЕФЙцдђЬэМгаТЯћЯЂЃЛЖдЯћЯЂЖгСагаЖСШЈЯоЕФНјГЬдђПЩвдДгЯћЯЂЖгСажа ЖСзпЯћЯЂЁЃЯћЯЂЖгСаЪЧЫцФкКЫГжајЕФЁЃ

ЪВУДЪЧЦьгяЁЂЪВУДЪЧаХКХСПЃК

LinuxЕФЦьгяОЭЪЧВйзїЯЕЭГдРэжаЕФаХКХСПЃЌгаPVВйзїЃЌЪЭЗХЦьгяЛсздЖЏЛНабЯТвЛИіЕШД§ЛёШЁЦьгяЕФНјГЬЃЛ

ЮЊСЫЗРжЙГіЯжвђЖрИіГЬађЭЌЪБЗУЮЪвЛИіЙВЯэзЪдДЖјв§ЗЂЕФвЛЯЕСаЮЪЬтЃЌЮвУЧашвЊвЛжжЗНЗЈЃЌЫќПЩвдЭЈЙ§ЩњГЩВЂЪЙгУСюХЦРДЪкШЈЃЌдкШЮвЛЪБПЬжЛФмгавЛИіжДааЯпГЬЗУ ЮЪДњТыЕФСйНчЧјгђЁЃСйНчЧјгђЪЧжИжДааЪ§ОнИќаТЕФДњТыашвЊЖРеМЪНЕижДааЁЃЖјаХКХСПОЭПЩвдЬсЙЉетбљЕФвЛжжЗУЮЪЛњжЦЃЌШУвЛИіСйНчЧјЭЌвЛЪБМфжЛгавЛИіЯпГЬдкЗУЮЪ ЫќЃЌвВОЭЪЧЫЕаХКХСПЪЧгУРДЕїаНјГЬЖдЙВЯэзЪдДЕФЗУЮЪЕФЁЃ

аХКХСПЪЧвЛИіЬиЪтЕФБфСПЃЌГЬађЖдЦфЗУЮЪЖМЪЧдзгВйзїЃЌЧвжЛдЪаэЖдЫќНјааЕШД§ЃЈМДP(аХКХБфСП))КЭЗЂЫЭЃЈМДV(аХКХБфСП))аХЯЂВйзїЁЃзюМђЕЅЕФаХКХСПЪЧжЛФмШЁ0КЭ1ЕФБфСПЃЌетвВЪЧаХКХСПзюГЃМћЕФвЛжжаЮЪНЃЌНазіЖўНјжЦаХКХСПЁЃЖјПЩвдШЁЖрИіе§ећЪ§ЕФаХКХСПБЛГЦЮЊЭЈгУаХКХСПЁЃ

ЪВУДЪЧЙВЯэФкДцЃК

ЙЫУћЫМвхЃЌЙВЯэФкДцОЭЪЧдЪаэСНИіВЛЯрЙиЕФНјГЬЗУЮЪЭЌвЛИіТпМФкДцЁЃЙВЯэФкДцЪЧдкСНИіе§дкдЫааЕФНјГЬжЎМфЙВЯэКЭДЋЕнЪ§ОнЕФвЛжжЗЧГЃгааЇЕФЗНЪНЁЃВЛЭЌНјГЬжЎ МфЙВЯэЕФФкДцЭЈГЃАВХХЮЊЭЌвЛЖЮЮяРэФкДцЁЃНјГЬПЩвдНЋЭЌвЛЖЮЙВЯэФкДцСЌНгЕНЫќУЧздМКЕФЕижЗПеМфжаЃЌЫљгаНјГЬЖМПЩвдЗУЮЪЙВЯэФкДцжаЕФЕижЗЃЌОЭКУЯёЫќУЧЪЧгЩгУC гябдКЏЪ§mallocЗжХфЕФФкДцвЛбљЁЃЖјШчЙћФГИіНјГЬЯђЙВЯэФкДцаДШыЪ§ОнЃЌЫљзіЕФИФЖЏНЋСЂМДгАЯьЕНПЩвдЗУЮЪЭЌвЛЖЮЙВЯэФкДцЕФШЮКЮЦфЫћНјГЬЁЃ

Ъ§ОнДцДЂЕФМИжжРраЭЃК

9

9

1.1ДцДЂЕФИХФюгыЪѕгя

1.1.3 DAS НщЩм

DAS ЪЧжБСЌЪНДцДЂЃЈDirect-Attached Storage)ЕФМђГЦЃЌЪЧжИНЋДцДЂЩшБИЭЈЙ§SCSIНгПк ЛђЙтЯЫЭЈЕРжБНгСЌНгЕНвЛЬЈМЦЫуЛњЩЯЁЃЕБЗўЮёЦїдкЕиРэЩЯБШНЯЗжЩЂЃЌКмФбЭЈЙ§дЖГЬНјааЛЅСЌ ЪБЃЌDASЪЧБШНЯКУЕФНтОіЗНАИЁЃЕЋЪЧетжжЪНДцДЂжЛФмЭЈЙ§гыжЎСЌНгЕФжїЛњНјааЗУЮЪЃЌВЛФмЪЕЯжЪ§ОнгыЦфЫћжїЛњЕФЙВЯэЃЌЭЌЪБЃЌDASЛсеМгУЗўЮёЦїВйзїЯЕЭГзЪдДЃЌ Р§ШчCPUзЪдДЁЂIOзЪ дДЕШЃЌВЂЧвЪ§ОнжУдНДѓЃЌеМгУВйзїЯЕЭГзЪдДОЭдНбЯжиЁЃ

NASЃК(Network Attach Srorage)ЭјТчИНМгДцДЂЃЌЫќ ОЭЪЧИіЮФМўЗўЮёЦїЃЌЪЧЮФМўЯЕЭГМЖБ№ЃЌNASКЭДЋЭГЕФЮФМўДцДЂЗўЮёЛђжБНгДцДЂЩшБИВЛЭЌЕФЕиЗНдкгкNASЩшБИЩЯУцЕФВйзїЯЕЭГКЭШэМўжЛЬсЙЉСЫЪ§ОнДцДЂЁЂЪ§ОнЗУ ЮЪЁЂвдМАЯрЙиЕФЙмРэЙІФмЃЛДЫЭтЃЌNASЩшБИвВЬсЙЉСЫВЛжЙвЛжжЮФМўДЋЪфавщЁЃNASЯЕЭГЭЈГЃгавЛИівдЩЯЕФгВХЬЃЌЖјЧвКЭДЋЭГЕФЮФМўЗўЮёЦївЛбљЃЌЭЈГЃЛсАбЫќУЧзщ ГЩRAIDРДЬсЙЉЗўЮёЃЛгаСЫNASвдКѓЃЌЭјТчЩЯЕФЦфЫћЗўЮёЦїОЭПЩвдВЛБидйМцШЮЮФМўЗўЮёЦїЕФЙІФмЁЃNASЕФаЭЪНКмЖрбљЛЏЃЌПЩвдЪЧвЛИіДѓСПЩњВњЕФЧЖШыЪНЩшБИЃЌ вВПЩвддквЛАуЕФМЦЫуЛњЩЯдЫааNASЕФШэМўЁЃ

NASгУЕФЪЧвдЮФМўЮЊЕЅЮЛЕФЭЈаХавщЃЌР§ШчЯёЪЧNFSЃЈдкUNIXЯЕЭГЩЯКмГЃМћЃЉЛђЪЧSMBЃЈГЃ гУгкWindowsЯЕЭГЃЉЁЃNASЫљгУЕФЪЧвдЮФМўЮЊЕЅЮЛЕФЭЈаХавщЃЌДѓМвЖМКмЧхГўЫќУЧЕФдЫзїФЃЪНЃЌЯрЖджЎЯТЃЌДцДЂЧјгђЭјТчЃЈSANЃЉгУЕФдђЪЧвдЧјПщЮЊЕЅЮЛ ЕФЭЈаХавщЁЂЭЈГЃЪЧЭЈЙ§SCSIдйзЊЮЊЙтЯЫЭЈЕРЛђЪЧiSCSIЁЃЃЈЛЙгаЦфЫћИїжжВЛЭЌЕФSANЭЈаХавщЃЌЯёЪЧATA over EthernetКЭHyperSCSIЃЌВЛЙ§етаЉЖМВЛГЃМћЁЃЃЉ

SANЃК(Storage Area Network)ДцДЂЧјгђЭјТчЃЌАб SCSIавщНшжњгкЦфЫќЭјТчавщЪЕЯжДЋЫЭЕФЃЛ1991ФъЃЌIBMЙЋЫОдкS/390ЗўЮёЦїжаЭЦГіСЫESCON(Enterprise System Connection)ММЪѕЁЃЫќЪЧЛљгкЙтЯЫНщжЪЃЌзюДѓДЋЪфЫйТЪДя17MB/sЕФЗўЮёЦїЗУЮЪДцДЂЦїЕФвЛжжСЌНгЗНЪНЁЃдкДЫЛљДЁЩЯЃЌНјвЛВНЭЦГіСЫЙІФмИќЧПЕФ ESCON Director(FC SWitch)ЃЌЙЙНЈСЫвЛЬззюдЪМЕФSANЯЕЭГЁЃ

ЫќЪЧвЛжжИпЫйЭјТчЛђзгЭјТчЃЌЬсЙЉдкМЦЫуЛњгыДцДЂЯЕЭГжЎМфЕФЪ§ОнДЋЪфЁЃДцДЂЩшБИЪЧжИвЛЬЈЛђЖрЬЈгУвдДцДЂМЦЫуЛњЪ§ОнЕФДХХЬЩшБИЃЌЭЈГЃжИДХХЬеѓСаЁЃ

DASЁЂNASКЭSANШ§жжДцДЂЗНЪНБШНЯ

ДцДЂгІгУзюДѓЕФЬиЕуЪЧУЛгаБъзМЕФЬхЯЕНсЙЙЃЌетШ§жжДцДЂЗНЪНЙВДцЃЌЛЅЯрВЙГфЃЌвбОКмКУТњзуЦѓвЕаХЯЂЛЏгІгУЁЃ

Дг СЌНгЗНЪНЩЯЖдБШЃЌDASВЩгУСЫДцДЂЩшБИжБНгСЌНггІгУЗўЮёЦїЃЌОпгавЛЖЈЕФСщЛюадКЭЯожЦадЃЛNASЭЈЙ§ЭјТчЃЈTCP/IP,ATM,FDDIЃЉММЪѕСЌНгДцДЂ ЩшБИКЭгІгУЗўЮёЦїЃЌДцДЂЩшБИЮЛжУСщЛюЃЌЫцзХЭђезЭјЕФГіЯжЃЌДЋЪфЫйТЪгаСЫКмДѓЕФЬсИпЃЛSANдђЪЧЭЈЙ§ЙтЯЫЭЈЕРЃЈFibre ChannelЃЉММЪѕСЌНгДцДЂЩшБИКЭгІгУЗўЮёЦїЃЌОпгаКмКУЕФДЋЪфЫйТЪКЭРЉеЙадФмЁЃШ§жжДцДЂЗНЪНИїгагХЪЦЃЌЯрЛЅЙВДцЃЌеМЕНСЫДХХЬДцДЂЪаГЁЕФ70%вдЩЯЁЃ SANКЭNASВњЦЗЕФМлИёШдШЛдЖдЖИпгкDAS.аэЖргУЛЇГігкМлИёвђЫиПМТЧбЁдёСЫЕЭаЇТЪЕФжБСЌДцДЂЖјВЛЪЧИпаЇТЪЕФЙВЯэДцДЂЁЃ

ПЭЙлЕФЫЕЃЌSANКЭNASЯЕЭГвбОПЩвдРћгУРрЫЦздЖЏОЋМђХфжУЃЈthin provisioningЃЉетбљЕФММЪѕРДУжВЙдчЦкДцДЂЗжХфВЛСщЛюЕФЖЬАхЁЃШЛЖјЃЌжЎЧАЫќУЧЯћКФСЫЬЋЖрЕФЪБМфРДНтОіДцДЂЗжХфЕФЮЪЬтЃЌвджСгкИјDASСєгазуЙЛЕФ ЪБМфдкЪ§ОнжааФСьгђеОЮШНХИњЁЃДЫЭтЃЌSANКЭNASвРШЛЮЪЬтЖрЖрЃЌжСНёЮоЗЈНтОіЁЃ

DRBDдкдЖГЬДЋЪфЩЯжЇГжШ§жжФЃЪНЃК

1ЁЂвьВНЃКЫљЮНвьВНОЭЪЧжИЪ§ОнжЛашвЊЗЂИјБОЕиЕФTCP/IPавщеЛОЭПЩвдСЫЃЌБОЕиДцЭъОЭOKЃЛЖјDRBDжЛашвЊАбЪ§ОнЗХЕНTCP/IPавщеЛЃЌЗХЕНЗЂЫЭЖгСажазМБИЗЂЫЭОЭЗЕЛиСЫЃЛетжжЗНЪНИќИпаЇЃЛ

2ЁЂАыЭЌВНЃКЪ§ОнвбОЗЂЫЭЕНЖдЗНЕФTCP/IPавщеЛЩЯЃЌЖдЗНЕФTCP/IPавщеЛвбОАбЪ§ОнНгЪеЯТРДСЫОЭЗЕЛиЃЌЪ§ОнДцВЛДцЯТРДОЭВЛЙмСЫЃЛ

3ЁЂЭЌВНЃКЪ§ОнБиаыШЗБЃЖдЗНАбЪ§ОнаДШыЖдЗНЕФДХХЬдйЗЕЛиЕФОЭНаЭЌВНЃЛетжжЗНЪНЪ§ОнИќПЩППЃЛ

ЙйЗНЬсЙЉЕФDRBDЕФЙЄзїСїГЬЭМЃК

====================DRBD + CorosyncЁЂPacemakerЪЕЯжDRBDНЧЩЋздЖЏЧаЛЛ=======================

дк дЫааdrbdЪБЃЌЫћВЂВЛЛсздЖЏЭъГЩНЧЩЋЕФЧаЛЛЃЌФЧдѕУДШУЫќОпгаетбљЕФЙІФмФиЃЌетРяОЭЕУгУЕНCorosync+PacemakerСЫЃЌНсКЯ corosync+pacemakerЕФdrbdОЭПЩвдздЖЏЭъГЩНЧЩЋЕФЧаЛЛЃЌвЛЕЉвЛИіdrbdЕФНкЕуГіЯжЙЪеЯОЭПЩвдздЖЏЧаЛЛЕНБ№вЛИіНкЕуЩЯМЬајЬсЙЉЗўЮёЃЌ ФЧНгЯТРДЮвУЧОЭРДХфжУвЛЯТdrbd + corosyncЁЂpacemakerЕФЪЕЯжЃЛ

ЕквЛВНЃКХфжУСНИіНкЕуЩЯЕФЫЋЛњЛЅаХЃЌетВНЮвЧАУцЕФВЉЮФжавбОаДЕНЙ§СЫЃЌПЩвдВЮЪ§ЧАУцЕФВЉЮФЃКCentOS 6.5 heartbeatИпПЩгУМЏШКЕФЯъНтЪЕЯжвдМАЙЄзїСїГЬЃЛ

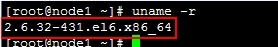

ЕкЖўВНЃКАВзАDRBDГЬађАќЃЌетвЛВНвЛЖЈвЊИёЭтзЂвтАцБОЦЅХфЮЪЬтЃК

ФкКЫФЃПщГЬађАќвЛЖЈвЊИњФуЕФЯЕЭГФкКЫБЃГжвЛжТЃЌuname -rВщПДФуЕФФкКЫАцБОЃЌФкКЫФЃПщЕФАцБОБиаывЊбЯИёЖдгІЃЌЖјгУЛЇПеМфЕФФЃПщОЭВЛФЧУДбЯИёвЊЧѓСЫЃЌСНИіНкЕуЕФЪБМфвВашвЊБЃГжвЛжТадЃЛ

drbd-8.4.3-33.el6.x86_64.rpm -->гУЛЇПеМфЙЄОп

drbd-kmdl-2.6.32-431.el6-8.4.3-33.el6.x86_64.rpm -->ФкКЫПеМфФЃПщЃЌетИіБиаывЊИњФкКЫАцБОБЃГжвЛжТ

# yum -y install drbd-8.4.3-33.el6.x86_64.rpm drbd-kmdl-2.6.32-431.el6-8.4.3-33.el6.x86_64.rpm УПИіНкЕуЖМашвЊАВзАЩЯетСНИіГЬађАќ

АВзАЭъГЩПЩвдПДвЛЯТdrbdЕФХфжУЮФМўЃК

# vim /etc/drbd.conf жїХфжУЮФМў

# vim /etc/drbd.d/global_common.conf ШЋОжКЭcommonЕФХфжУ

global { #ШЋОжХфжУ

usage-count no; #етИіЮЊyesБэЪОШчЙћФуБОЛњПЩвдСЌНгЛЅСЊЭјЪБdrbdЛсЭЈЙ§ЛЅСЊЭјЪеМЏЕНФуАВзАdrbdЕФаХЯЂЃЌЙйЗНЭГМЦЫЕгжЖрСЫвЛИіШЫЪЙгУdrbdЪЕР§ЃЌВЛгУПЩвдИФЮЊno

# minor-count dialog-refresh disable-ip-verification

}

common {

handlers { #ДІРэЦї

# These are EXAMPLE handlers only.

# They may have severe implications,

# like hard resetting the node under certain circumstances.

# Be careful when chosing your poison.

pri-on-incon-degr "/usr/lib/drbd/notify-pri-on-incon-degr.sh; /usr/lib/drbd/notify-emergency-reboot.sh; echo b > /proc/sysrq-trigger ; reboot -f"; ЖЈвхСЫШчЙћжїНкЕуНЕМЖСЫдѕУДДІРэЕФ

pri-lost-after-sb "/usr/lib/drbd/notify-pri-lost-after-sb.sh; /usr/lib/drbd/notify-emergency-reboot.sh; echo b > /proc/sysrq-trigger ; reboot -f"; етИіЖЈвхСЫШчЙћгаФдСбСЫжЎКѓевВЛЕНжїНкЕудѕУДДІРэЕФ

local-io-error "/usr/lib/drbd/notify-io-error.sh; /usr/lib/drbd/notify-emergency-shutdown.sh; echo o > /proc/sysrq-trigger ; halt -f"; ЖЈвхСЫвЛЕЉБОЕиНкЕуЗЂЩњIOДэЮѓЪБгІИУдѕУДДІРэ

# fence-peer "/usr/lib/drbd/crm-fence-peer.sh";

# split-brain "/usr/lib/drbd/notify-split-brain.sh root";

# out-of-sync "/usr/lib/drbd/notify-out-of-sync.sh root";

# before-resync-target "/usr/lib/drbd/snapshot-resync-target-lvm.sh -p 15 -- -c 16k";

# after-resync-target /usr/lib/drbd/unsnapshot-resync-target-lvm.sh;

}

startup { ЖЈвхвЛИіНкЕуЦєЖЏЪБСэвЛИіНкЕугІИУдѕУДзі

# wfc-timeout(ЕШД§СэвЛИіНкЕуЩЯЯпЕФГЌЪБЪБГЄ)

# degr-wfc-timeout(ЕШД§ГЌЪБКѓзіНЕМЖДІРэ)

# outdated-wfc-timeout(Й§ЦкЕФЕШД§ГЌЪБ)

# wait-after-sb(ФдСбжЎКѓЕШД§ЖрГЄЪБГЄ)

}

options {

# cpu-mask on-no-data-accessible

}

disk {

on-io-error detach;

# size max-bio-bvecs on-io-error fencing disk-barrier disk-flushes

# disk-drain md-flushes resync-rate resync-after al-extents

# c-plan-ahead c-delay-target c-fill-target c-max-rate

# c-min-rate disk-timeout

}

net {

protocol C;

cram-hmac-alg "sha1";

shared-secret "drbd.tanxw.com";

# protocol timeout max-epoch-size max-buffers unplug-watermark

# connect-int ping-int sndbuf-size rcvbuf-size ko-count

# allow-two-primaries cram-hmac-alg shared-secret after-sb-0pri

# after-sb-1pri after-sb-2pri always-asbp rr-conflict

# ping-timeout data-integrity-alg tcp-cork on-congestion

# congestion-fill congestion-extents csums-alg verify-alg

# use-rle

}

syncer {

rate 1000M;

}

}

БЃДцЭЫГіЁЃ

ЕкШ§ВНЃКЮЊСНИіНкЕузМБИЕШЭЌДѓаЁЕФДХХЬЗжЧјЃЌЗжЧјКУжЎКѓВЛашвЊИёЪНЛЏЃЌЗжКУЧјВЂЧвЪЖБ№ГіОЭПЩвдСЫЃЛ

[root@node2 drbd.d]# fdisk /dev/sda

WARNING: DOS-compatible mode is deprecated. It's strongly recommended to

switch off the mode (command 'c') and change display units to

sectors (command 'u').

Command (m for help): p

Disk /dev/sda: 85.9 GB, 85899345920 bytes

255 heads, 63 sectors/track, 10443 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x000e89e2

Device Boot Start End Blocks Id System

/dev/sda1 * 1 26 204800 83 Linux

Partition 1 does not end on cylinder boundary.

/dev/sda2 26 7859 62914560 8e Linux LVM

/dev/sda3 7859 9164 10489446 8e Linux LVM

Command (m for help): n

Command action

e extended

p primary partition (1-4)

e

Selected partition 4

First cylinder (9165-10443, default 9165):

Using default value 9165

Last cylinder, +cylinders or +size{K,M,G} (9165-10443, default 10443):

Using default value 10443

Command (m for help): n

First cylinder (9165-10443, default 9165):

Using default value 9165

Last cylinder, +cylinders or +size{K,M,G} (9165-10443, default 10443): +3G

Command (m for help): p

Disk /dev/sda: 85.9 GB, 85899345920 bytes

255 heads, 63 sectors/track, 10443 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x000e89e2

Device Boot Start End Blocks Id System

/dev/sda1 * 1 26 204800 83 Linux

Partition 1 does not end on cylinder boundary.

/dev/sda2 26 7859 62914560 8e Linux LVM

/dev/sda3 7859 9164 10489446 8e Linux LVM

/dev/sda4 9165 10443 10273567+ 5 Extended

/dev/sda5 9165 9557 3156741 83 Linux

Command (m for help): w

The partition table has been altered!

Calling ioctl() to re-read partition table.

WARNING: Re-reading the partition table failed with error 16: Device or resource busy.

The kernel still uses the old table. The new table will be used at

the next reboot or after you run partprobe(8) or kpartx(8)

Syncing disks.

[root@node2 drbd.d]# kpartx -af /dev/sda

device-mapper: reload ioctl on sda1 failed: Invalid argument

create/reload failed on sda1

device-mapper: reload ioctl on sda2 failed: Invalid argument

create/reload failed on sda2

device-mapper: reload ioctl on sda3 failed: Invalid argument

create/reload failed on sda3

device-mapper: reload ioctl on sda4 failed: Invalid argument

create/reload failed on sda4

device-mapper: reload ioctl on sda5 failed: Invalid argument

create/reload failed on sda5

[root@node2 drbd.d]# partx -a /dev/sda

BLKPG: Device or resource busy

error adding partition 1

BLKPG: Device or resource busy

error adding partition 2

BLKPG: Device or resource busy

error adding partition 3

[root@node2 drbd.d]# partx -a /dev/sda

BLKPG: Device or resource busy

error adding partition 1

BLKPG: Device or resource busy

error adding partition 2

BLKPG: Device or resource busy

error adding partition 3

BLKPG: Device or resource busy

error adding partition 4

BLKPG: Device or resource busy

error adding partition 5

[root@node2 drbd.d]#

ЕкЫФВНЃКИљОнЩЯУцЕФУшЪіЃЌЮвУЧвЊИјЫќЖЈвхзЪдДЃЌАќРЈзЪдДУћЃЌdrbdЩшБИЃЌdiskвдМАЭјТчЪєадЃЌжївЊЪЧетЫФИіЗНУцЃЛ

ЖЈвхвЛИізЪдД/etc/drbd.d/ЃЌФкШнШчЯТЃК

# cd /etc/drbd.d/

# vim mystore.res

resource mystore { #ЖЈвхвЛИізЪдДЃЌгУЙиМќзжresourceЃЛ

on node1.tanxw.com { #onЫЕУїдкФФИіНкЕуЩЯЃЌИњuname -nБЃГжвЛжТ,гаЖрЩйИіНкЕуОЭЖЈвхЖрЩйИіЃЛ

device /dev/drbd0; #дкДХХЬЩЯБэЯжЕФdrbdНаЪВУДУћЃЛ

disk /dev/sda5; #ЫљЪЙгУЕФДХХЬЩшБИЪЧФФИіЃЛ

address 172.16.27.1:7789; #дкnode1етИіНкЕуЩЯМрЬ§ЕФЬзНгзж,ФЌШЯМрЬ§дк7789ЖЫПкЩЯЃЛ

meta-disk internal; #БЃДцdrbdдЊЪ§ОнаХЯЂЕФЃЌБэЪООЭЗХдкздМКЕФДХХЬЧјЗжЩЯЃЌвВПЩвдЗХдкЭтВПЕФДХХЬЩЯЃЛ

}

on node2.tanxw.com {

device /dev/drbd0;

disk /dev/sda5;

address 172.16.27.2:7789;

meta-disk internal;

}

}

БЃДцЭЫГіЃЌИДжЦвЛЗнЕНБ№вЛИіНкЕуЩЯЃЌЫќУЧЕФХфжУЮФМўвЊБЃГжвЛжТЃК

# scp global_common.conf mystore.res node2.tanxw.com:/etc/drbd.d/

# drdbadm create-md mystore дкИїздЕФНкЕуЩЯГѕЪМЛЏзЪдД

# server drbd start ЦєЖЏdrbd

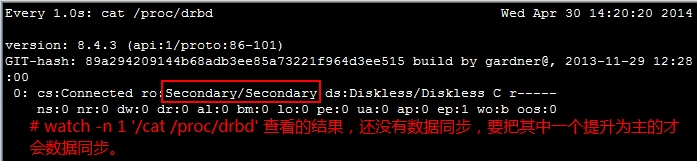

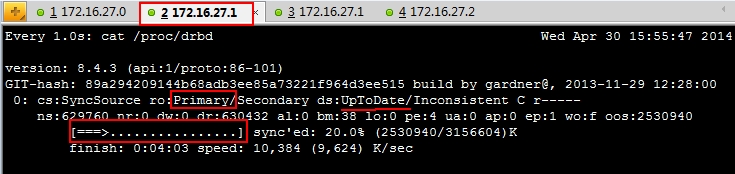

# watch -n 1 'cat /proc/drbd' ЪЕЯжВщПДДХХЬаХЯЂ

# drbdadm primary --force mystore дкНкЕуЩЯАбЦфжавЛИіЬсЩ§ЮЊжїЕФ

# watch -n 1 'cat /proc/drbd' ЬсЩ§ЮЊжїЕФжЎКѓдйЪЕЯжВщПДДХХЬаХЯЂ

зЂвтЃКФФИіЪЧжїНкЕуФФИіОЭПЩвдЙвдиЪЙгУЃЌВЛЪЧжїНкЕуЕФСЌЙвдиЖМВЛПЩвдЙвдиЃЛ

OKЁЂПДЕНСНИіНкЕуЩЯЕФЪ§Оне§дкЭЌВНСЫЃЌДХХЬдНДѓЭЌВНЪБашвЊЪБМфдНОУЃЛ

ЕкЮхВНЃКдкЦфжавЛИіНкЕуЩЯНјааИёЪНЛЏЃК

# scp global_common.conf mystore.res node2.tanxw.com:/etc/drbd.d/

# drdbadm create-md mystore дкИїздЕФНкЕуЩЯГѕЪМЛЏзЪдД

# server drbd start ЦєЖЏdrbd

# watch -n 1 'cat /proc/drbd' ЪЕЯжВщПДДХХЬаХЯЂ

# drbdadm primary --force mystore дкНкЕуЩЯАбЦфжавЛИіЬсЩ§ЮЊжїЕФ

# watch -n 1 'cat /proc/drbd' ЬсЩ§ЮЊжїЕФжЎКѓдйЪЕЯжВщПДДХХЬаХЯЂ

КУСЫЃЌЕНетРяОЭЭъГЩЕФdrbdЕФЙЄзїФЃЪНОЭетУДЫГРћЕФЭъГЩСЫЃЌЮвВЛжЊЕРЮвЪЧЗёЫЕУїАзСЫЃЁ

вЊЭъГЩdrbdЕФНЧЩЋздЖЏЧаЛЛЕУвЊНшжњгкcorosync+pacmakerЃЌФЧНгЯТРДЮвУЧОЭРДАВзАХфжУcorosyncКЭpacemakerАЩЃЛ

ЮЊСЫШУИпПЩгУЕФХфжУЫГРћЃЌСНИіНкЕуЖМВЛФмЩшжУЮЊжїЕФЃЌЖјЧвЖМВЛФмЦєЖЏЃЌвВВЛФмПЊЛњздЖЏЦєЖЏЃЌЫљвдаЖдиНЕМЖЃК

# cd

# umount /dev/drbd0

# drbdadm secondary mystore ФФИіЪЧжїЕФОЭдкФФЯрНкЕуЩЯНЕМЖ

# service drbd stop СНИіНкЕуЖМашвЊЭЃжЙЗўЮё

# chkconfig drbd off

ЕкСљВНЃКАВзАcorosync + pacemakerЃЌетРяжБНггУyumРДАВзАЃЌСНИіНкЕуЖМвЊАВзАЩЯЃЛ

# yum -y install corosync pacemaker

# yum -y install crmsh pssh

# cp /etc/corosync.conf.example /etc/corosync/corosync.conf

# vim /etc/corosync/corosync.conf

compatibility: whitetank

totem {

version: 2

secauth: on

threads: 0

interface {

ringnumber: 0

bindnetaddr: 172.16.0.0

mcastaddr: 226.98.188.188

mcastport: 5405

ttl: 1

}

}

logging {

fileline: off

to_stderr: no

to_logfile: yes

to_syslog: no

logfile: /var/log/cluster/corosync.log

debug: off

timestamp: on

logger_subsys {

subsys: AMF

debug: off

}

}

amf {

mode: disabled

}

service {

name: pacemaker

ver: 0

}

aisexce {

user: root

group: root

}

# mv /dev/random /dev/m

# ln /dev/urandom /dev/random ШчЙћетАбетИіЫцЛњЪ§ЩЪГиИФСЫПЩвдЛсВњЩњЫцЛњЪ§ВЛЙЛгУЃЌетИіОЭвЊЧУЛїМќХЬИјетИіЩЪГивЛаЉЫцЛњЪ§ЃЛЩњГЩЭъетИіkeyКѓАбСДНгЩОГ§ЃЌдйАбЩЪГиИФЛиРДЃЛВЛЙ§етбљИФПЩвдЛсгаЕуЮЊАВШЋЃЌВЛЙ§зіВтЪдЕФгІИУВЛвЊНєЃЛ

# corosync-keygen

# rm -rf /dev/random

# mv /dev/m /dev/random

дйАбИФКУЕФХфжУИДжЦвЛЗнЕНБ№вЛИіНкЕуЩЯШЅЃЌвВБЃСєвЛЗнИјСэвЛИіНкЕуЃК

# scp -p authkey corosync.conf node2.tanxw.com:/etc/corosync/

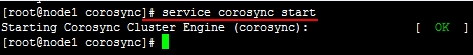

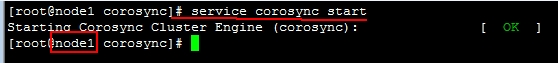

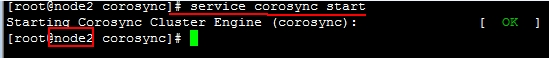

ЦєЖЏCorosyncЃЌУПИіНкЕуЖМашвЊЦєЖЏЃЛ

ЕкЦпВНЃКНгЯТРДНјШыcrmУќСюааНгПкЖЈвхзЪдДЃК

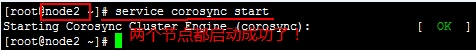

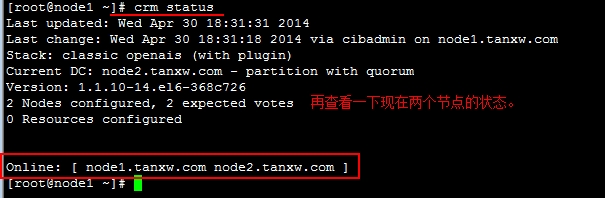

# crm status ВщПДНкЕуЕФдЫаазДЬЌ

# crm

# configure

# property stonith-enabled=false

# property no-quorum-policy=ignore

# rsc_defaults resource-stickiness=100

# verify

# commit

# show

# meta ocf:linbit:drbd ВщПДdrbdЕФЯъЯИаХЯЂ

# ЖЈвхзЪдД,ЧаЛЛЕНconfigureжаЃЌmysqlstoreЖЈвхзЪдДУћЃЌdrbd_resource=mystoreетИіЪЧdrbdУћЃЌКѓУцЖЈвхЕФЖМЪЧвЛаЉМрПи

# primitive mysqlstore ocf:linbit:drbd params drbd_resource=mystore op monitor role=Master interval=30s timeout=20s op monitor role=Slave interval=60s timeout=20s op start timeout=240s op stop timeout=100s

# verify МьВщгяЗЈ

# ЖЈвхжїзЪдД

# master ms_mysqlstore mysqlstore meta master-max=1 master-node-max=1 clone-max=2 clone-node-max=1 notify=”True”

# verify

#commit

ЖЈвхЙВЯэЮФМўЕФзЪдД,ВЂЧвШУЗўЮёЦїЧаЛЛЪБПЩвдздЖЏЙвдиЃЌdevice=/dev/drbd0ЙвдиЕФЩшБИЃЌdirectory=/drbdЙвдиЕуЃЌСНИіЙвдиЕуЕФЮФМўУћвЊвЛжТЃК

# primitive mysqlfs ocf:heartbeat:Filesystem params device=/dev/drbd0 directory=/drbd fstype=ext4 op monitor interval=30s timeout=40s on-fail-restart op start timeout=60s op stop timeout=60s

# verify

ЖЈвхХХСадМЪјЃК

# collocation mysqlfs_with_ms_mysqlstore_master inf: mysqlfs ms_mysqlstore:Master

# verify

ЖЈвхЫГађдМЪјЃК

# order mysqlfs_after_ms_mysqlstore_master mandatory: ms_mysqlstore:promote mysqlfs:start

# show

# commit

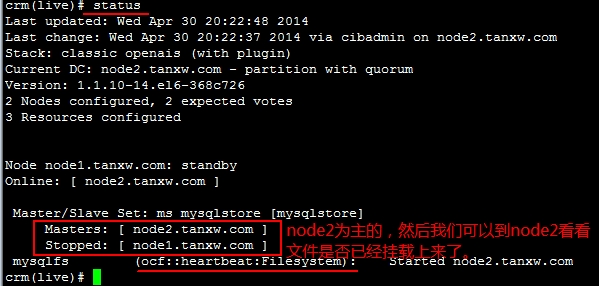

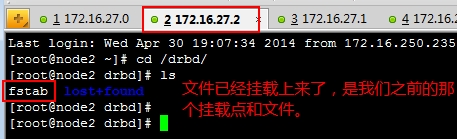

OKЃЌдйВщПДвЛЯТЫќУЧЯждкЕФзДЬЌЃЌnode2ЪЧжїЕФЃЌЖјnode1ЪЧДгЕФЃЌПЩвдЕНnode2ЩЯВщПДЮФМўЪЧЗёвбОЙвдиЩЯШЅЕФЃЌбщжЄвЛЯТЃЌдйДДНЈЛђаоИФМИИіЮФМўНјШЅЖМПЩвдзівЛЯТВтЪдЕФЃЌЖјКѓдйШУnode2ЭЃЕєЃЌПДПДnode1ЪЧЗёЛсздЖЏЧаЛЛЮЊжїЕФЃК

ИФБфНкЕуЕФжїДгЮЛжУЃК

crm(live)# node standby node2.tanxw.com Абnode2ЬсЩ§ЮЊБИгУЕФ

crm(live)# node noline node2.tanxw.com ШУnode2ЩЯЯп

crm(live)# node standby node1.tanxw.com Абnode1ЬсЩ§ЮЊБИгУЕФ

crm(live)# node noline node1.tanxw.com ШУnode1ЩЯЯпЃЌЖМПЩвдЫцвтЧаЛЛвЛЯТдйМьВтвЛЯТЙвдиЕФаЇЙћЕФЃЛ

(д№ШЮБрМЃКIT)

CorosyncЃКЫќЪєгкOpenAIS(ПЊЗХЪНгІгУНгПкЙцЗЖ)жаЕФвЛИіЯюФПcorosyncвЛАцБОжаБОЩэВЛОп БИЭЖЦБЙІФмЃЌЕНСЫcorosync 2.0жЎКѓв§ШыСЫvotequorumзгЯЕЭГвВОпБИСЫЭЖЦБЙІФмСЫЃЌШчЙћЮвУЧгУЕФЪЧ1АцБОЕФЃЌгжашвЊгУЕНЦБЪ§зіОіВпЪБФЧИУШчКЮЪЧКУФиЃЛЕБШЛЃЌдкКьУБЩЯАб cman + corosyncНсКЯЦ№РДгУЃЌЕЋЪЧдчЦкcmanИњpacemakerУЛЗЈНсКЯЦ№РДЃЌШчЙћЯыгУpacemakerгжЯыгУЭЖЦБЙІФмЕФЛАЃЌФЧОЭАбcmanЕБГЩ corosyncЕФВхМўРДгУЃЌАбcmanЕБГЩcorodyncЕФЭЖЦБЙІФмЃЌЕБШЛЃЌетРяНсКЯСЫСНИіСЫMessaging LaderЃЛCorosyncФПЧАгаСНИіжїСїЕФАцБОЃКвЛИіЪЧ2ЯЕСаЕФЃЌСэвЛИіЪЧ1ЯЕСаЕФЮШЖЈАцЃЛ2АцБОКЭ1АцБОВюБ№КмДѓЃЌ1АцБОВЛОпгаЭЖЦБЙІФмЃЌ2АцБОжЎ Кѓв§ШыСЫvotequorumКѓжЇГжЭЖЦБЙІФмСЫЃЛOpenAISздДгЕЎЩњжЎКѓЃЌКьУБОЭЛљгкетИіЙцЗЖбаЗЂСЫвЛИіИпПЩгУМЏШКЕФНтОіЗНАИНаcmanЃЌВЂЮЊcmanЬсЙЉСЫrgmangaerзїЮЊзЪдДЙмРэЦїЃЌВЂЧвШнКЯcongaШЋЩњУќжмЦкЕФЙмРэНгПкаЮГЩСЫRHCSЃЛ

ConrosyncЪЧДгOpenAISетИіДѓЯюФПжаЗжжЇГіРДЕФвЛИіЯюФПЃЌЖјPacemakerЪЧheartbeat v3АцБОжаЗжСбГіРДзЈУХгУгкЬсЙЉИпПЩгУМЏШКCRMЕФзщМўЃЌЙІФмЪЎЗжЧПДѓЃЌ CoreosyncдкДЋЕнаХЯЂЕФЪБКђПЩвдЭЈЙ§вЛИіМђЕЅЕФХфжУЮФМўРДЖЈвхаХЯЂДЋЕнЕФЗНЪНКЭавщЕШЃЌCorosyncПЩвдЬсЙЉвЛИіЭъећЕФHAЙІ ФмЃЌCorosyncЪЧЮДРДЕФЗЂеЙЗНЯђЃЌдквдКѓЕФаТЯюФПРяЃЌвЛАуВЩгУCorosyncЃЌЖјheartbeat_guiПЩвдЬсЙЉКмКУЕФHAЙмРэЙІФмЃЌПЩвдЪЕ ЯжЭМаЮЛЏЕФЙмРэЁЃ # vim /etc/hosts 172.16.27.1 node1.tanxw.com 172.16.27.2 node2.tanxw.com # ssh-keygen -t rsa -P ‘’ # ssh-copy-id -i id_rsa.pub node2.tanxw.com 2ЁЂАВзАcorosyncЃЌетРяЮвУЧгУansibleРДАВзАЃЌвЊЪЙгУansibleдквЛЬЈжїЛњЩЯВйзїЖрЬЈжїЛњЕУашвЊЪТЯШАВзАansibleЃЌФЧетРяЮвУЧ ОЭЯШЫЕЫЕАВзАКЭХфжУЪЙгУansibleЃЌАВзАansibleвВПЩвдгУyumРДАВзАЃЌВЛЙ§ашвЊНтОівРРЕЙиЯЕЃК # yum -y install python-jinja2 НтОівРРЕЙиЯЕ # yum -y install ansible АВзАКУжЎКѓдйШЅ/etc/ansibleЯТХфжУСНИіНкЕуЕФhostnameЃК # vim /etc/ansible/hosts АбРяУцЕФФкШнШЋЖМзЂЪЭЕєЃЌМгЯТУцФуЕФНкЕуhostname [corosync] node1.tanxw.com node2.tanxw.com

БЃДцЭЫГіЃЁ # yum -y install python-jinja2 НтОівРРЕЙиЯЕ # yum -y install ansible АВзАКУжЎКѓдйШЅ/etc/ansibleЯТХфжУСНИіНкЕуЕФhostnameЃК # vim /etc/ansible/hosts АбРяУцЕФФкШнШЋЖМзЂЪЭЕєЃЌМгЯТУцФуЕФНкЕуhostname [corosync] node1.tanxw.com node2.tanxw.com 3ЁЂЪБМфЭЌВНЃЌашвЊЪТЯШХфжУКУвЛЬЈЪБМфЗўЮёЦїЃЌШЛКѓдкcrontab -eжаЪфШыЃК # crontab -e */5 * * * * /usr/sbin/ntpdte 172.16.27.0 &> /dev/null БэЪОУПИє5ЗжжгЭЌВНвЛДЮ КУЃЌзМБИЙЄзїзіКУСЫжЎКѓОЭПЩвдАВзАcorosyncСЫЃЌЪЙгУansibleВщПДСНИіНкЕуЪЧЗёвбОАВзАСЫcorosyncЃК

[root@node0 ~]# ansible corosync -m shell -a 'rpm -q corosync' node2.tanxw.com | FAILED | rc=1 >> package corosync is not installed node1.tanxw.com | FAILED | rc=1 >> package corosync is not installed # ansible corosync -m yum -a "name=corosync state=present" ШЋВПЪфГіЯдЪОЮЊТЬЩЋЫЕУїАВзАГЩЙІ [root@node0 ~]# ansible corosync -m shell -a 'rpm -q corosync' дйВщПДвЛЯТcorosyncЕФАВзААцБО node2.tanxw.com | success | rc=0 >> corosync-1.4.1-17.el6.x86_64 node1.tanxw.com | success | rc=0 >> corosync-1.4.1-17.el6.x86_64 # cp /etc/corosync/corosync.conf.example /etc/corosync.conf ИДжЦвЛЗнcorosyncЕФбљБОХфжУЮФМў # vim /etc/corosync/corosync.conf БрМХфжУЮФМўаоИФШчЯТФкШн compatibility: whitetank #етИіБэЪОЪЧЗёМцШн0.8жЎЧАЕФАцБО totem { #ЭМЬкЃЌетЪЧгУРДЖЈвхМЏШКжаИїНкЕужаЪЧдѕУДЭЈаХЕФвдМАВЮЪ§ version: 2 #ЭМЬкЕФавщАцБОЃЌЫќЪЧжжавщЃЌавщЪЧгаАцБОЕФЃЌЫќЪЧгУгкИїНкЕуЛЅЯрЭЈаХЕФавщЃЌетЪЧЖЈвхАцБОЕФ secauth: on #БэЪОАВШЋШЯжЄЙІФмЪЧЗёЦєгУЕФ threads: 0 #ЪЕЯжШЯжЄЪБЕФВЂааЯпГЬЪ§ЃЌ0БэЪОФЌШЯХфжУ interface { # жИЖЈдкФФИіНгПкЩЯЗЂаФЬјаХЯЂЕФЃЌЫќЪЧИізгФЃПщ ringnumber: 0 #ЛЗКХТыЃЌМЏШКжагаЖрИіНкЕуЃЌУПИіНкЕуЩЯгаЖрИіЭјПЈЃЌБ№ЕФНкЕуПЩвдНгЪеЃЌЭЌЪБЮвУЧБОЛњЕФБ№вЛПщЭјПЈвВПЩвдНгЪеЃЌЮЊСЫБмУтетаЉаХЯЂдкетбљЕФЛЗзДЗЂЫЭЃЌвђДЫвЊЮЊетИіЭјПЈЖЈвхвЛИіЮЈвЛЕФЛЗКХТыЃЌвдБмУтаФЬјаХЯЂЛЗЗЂЫЭЁЃ bindnetaddr: 192.168.1.1 # АѓЖЈЕФЭјТчЕижЗ mcastaddr: 226.94.1.1 #ЖрВЅЕижЗЃЌвЛЖдЖрЭЈаХ mcastport: 5405 # ЖрВЅЖЫПк ttl: 1 # БэЪОжЛЯђЭтВЅвЛДЮ } } logging { # ИњШежОЯрЙи fileline: off to_stderr: no # БэЪОЪЧЗёашвЊЗЂЫЭЕНДэЮѓЪфГі to_logfile: yes #ЪЧВЛЪЧЫЭИјШежОЮФМў to_syslog: no #ЪЧВЛЪЧЫЭИјЯЕЭГШежО logfile: /var/log/cluster/corosync.log #ШежОЮФМўТЗОЖ debug: off #ЪЧЗёЦєЖЏЕїЪд timestamp: on #ШежОЪЧЗёашвЊМЧТМЪБМфДС logger_subsys { #ШежОЕФзгЯЕЭГ subsys: AMF debug: off } } amf { # ИњБрГЬНгПкЯрЙиЕФ mode: disabled } service { #ЖЈвхвЛИіЗўЮёРДЦєЖЏpacemaker ver: 0 #ЖЈвхАцБО name: pacemaker #етИіБэЪОЦєЖЏcorosyncЪБЛсздЖЏЦєЖЏpacemaker } aisexec { #БэЪОЦєЖЏaisЕФЙІФмЪБвдФФИігУЛЇЕФЩэЗнШЅдЫааЕФ user: root group: root #ЦфЪЕетИіПщЖЈвхВЛЖЈвхЖМПЩвдЃЌcorosyncФЌШЯОЭЪЧвдrootЩэЗнШЅдЫааЕФ } етРяЮвУЧИФвЛИіЫцЛњЪ§ЩЪГиЃЌдйАбХфжУКУЕФcorosyncЕФХфжУКЭШЯжЄЮФМўИДжЦЕНСэвЛИіНкЕуЩЯШЅЃК # mv /dev/random /dev/m # ln /dev/urandom /dev/random ШчЙћетАбетИіЫцЛњЪ§ЩЪГиИФСЫПЩвдЛсВњЩњЫцЛњЪ§ВЛЙЛгУЃЌетИіОЭвЊЧУЛїМќХЬИјетИіЩЪГивЛаЉЫцЛњЪ§ЃЛЩњГЩЭъетИіkeyКѓАбСДНгЩОГ§ЃЌдйАбЩЪГиИФЛиРДЃЛВЛЙ§етбљИФПЩвдЛсгаЕуЮЊАВШЋЃЌВЛЙ§зіВтЪдЕФгІИУВЛвЊНєЃЛ # corosync-keygen # rm -rf /dev/random # mv /dev/m /dev/random ЖдгкcorosyncЖјбдЃЌЮвУЧИїНкЕужЎМфЭЈаХЪББиаывЊФмЙЛЪЕЯжАВШЋШЯжЄЕФЃЌвЊгУЕНвЛИіУмдПЮФМўЃК # corosync-keygen # ЩњГЩУмдПЮФМўЃЌгУгкЫЋЛњЭЈаХЛЅаХЃЌЛсЩњГЩвЛauthkeyЕФЮФМў # scp authkey corosync.conf node2.tanxw.com:/etc/corosync/ дкХфжУКУЕФНкЕуЩЯАбетСНИіЮФМўИДжЦИјСэвЛИіНкЕуЩЯЕФcorosyncЕФХфжУЮФМўжаШЅ АВзАpacemaker # ansible corosync -m yum -a “name=pacemaker state=present” ЮвУЧвЊЯыЪЙгУpacemakerХфжУЕФЛАашвЊАВзАвЛИіpacemakerЕФНгПкЃЌЫќЕФетИіГЬађЕФНгПкНаcrmshellЃЌЫќдкаТАцБОЕФ pacemakerвбОБЛЖРСЂГіРДСЫЃЌВЛдйЪЧpacemakerЕФзщГЩВПЗжСЫЃЌдчЦкзАЩЯpacemakerОЭЛсздДјгаcrmshellЃЌвђДЫвЊЯыгУ crmshellЕФЛАЕУШЅАВзАcrmshellЃЌЖјАВзАcrmshellгжвРРЕгкpsshЕФЯрЙиАќЃЌвђДЫЕУАВзАетСНИізщМўЃЌ(етРяЕФетСНИіАќЪЧздМКжЦМў ЕФ)ЃЌФФИіНкЕуХфжУОЭАВзАдкФФИіНкЕуЩЯОЭПЩвдСЫЃЌвВЮоашСНИіНкЕуЖМАВзАетСНИіАќЃК crmsh-1.2.6-4.el6.x86_64.rpm pssh-2.3.1-2.el6.x86_64.rpm # yum -y install crmsh-1.2.6-4.el6.x86_64.rpm pssh-2.3.1-2.el6.x86_64.rpm

вЛЧаЖМOKСЫжЎКѓОЭПЩвдЦєЖЏЗўЮёСЫЃЌСНИіНкЕуЖМашвЊЦєЖЏЃК

дкетРяcrmЪЧвЛИіКмИДдгЕФУќСюЃЌПЩвддкУќСюаажБНгЪфШыcrmНјШыcrmЕФУќСюааФЃЪНЃК# crm

ФЧдкетРяЃЌЮвУЧШчКЮШЅХфжУвЛИізЪдДФиЃЌЫфШЛЫќИњheartbeatТдгаЧјБ№ЃЌЕЋЪЧИХФюЛљБОЩЯЪЧвЛбљЕФЃЌЯТУцЮвУЧОЭРДХфжУвЛИіwebзЪдДАЩЃЁ [root@node1 corosync]# crm configure #НјШыcrmУќСюааФЃЪНХфжУзЪдДЕШ crm(live)configure# property #ЧаЛЛЕНpropertyФПТМЯТЃЌПЩвдгУСНДЮtabМќНјааВЙШЋКЭВщПД usage: property [$id=<set_id>] <option>=<value> # propertyЕФгУЗЈКЭИёЪН crm(live)configure# property stonith-enabled=false #НћгУstonith-enabled crm(live)configure# verify #МьВщЩшжУЕФЪєадЪЧЗёе§ШЗ crm(live)configure# commit #МьВщУЛЮЪЬтОЭПЩвдЬсНЛСЫ crm(live)configure# show #ВщПДЕБЧАМЏШКЕФЫљгаХфжУаХЯЂ node node1.tanxw.com node node2.tanxw.com #СНИіНкЕу property $id="cib-bootstrap-options" \ dc-version="1.1.10-14.el6-368c726" \ #DCЕФАцБОКХ cluster-infrastructure="classic openais (with plugin)" \ #МЏШКЕФЛљДЁМмЙЙЃЌЪЙгУЕФЪЧOpenAISЃЌВхМўЪНЕФ expected-quorum-votes="2" \ #ЦкЭћНкЕуЕФЦБЪ§ stonith-enabled="false" #НћгУstonithЙІФм crm(live)configure# ВщПДвЛЯТНкЕуЕФдЫаазДЬЌЃК

вЊзЂвтЃКШчЙћвЛИіНкЕуЙвСЫЃЌОЭВЛгЕгаЗЈЖЈЦБЪ§СЫЃЌФЧзЪдДЪЧВЛЛсЧаЛЛЕФ

дйНјШыcrmЖЈвхЮвУЧЫљашвЊЕФзЪдДАЩЃЁ crm(live)# configure crm(live)configure# primitive webip ocf:heartbeat:IPaddr params ip=172.16.27.88 crm(live)configure# verify crm(live)configure# commit crm(live)configure# show node node1.tanxw.com node node2.tanxw.com primitive webip ocf:heartbeat:IPaddr \ params ip="172.16.27.88" property $id="cib-bootstrap-options" \ dc-version="1.1.10-14.el6-368c726" \ cluster-infrastructure="classic openais (with plugin)" \ expected-quorum-votes="2" \ stonith-enabled="false" crm(live)configure#

ЖЈвхвЛИізщЃЌАбжЎКѓЖЈвхЕФзЪдДМгЕНетИізщРяУцШЅЃК

ШУnode1НкЕуРыЯпЃК

КУСЫЃЌетжжЙІФмЮвУЧвВЭъГЩСЫЃЌШчЙћШУnode1ЩЯЯпЫќвВВЛЛсзЊЛиЕФЃЌвђЮЊЮвУЧУЛгаЖЈвхЫќЕФЧуЯђадКЭЙЪеЯзЊЛиЃЌЫљвдnode1ЛиРДОЭЛиРДАЩЃЌЖјЗўЮёвРШЛдЫаадкnode2ЩЯЃЛ

DRBD (Distributed Replicated Block Device)ЗжВМЪНИДжЦПщЩшБИЃЌЫќЪЧ Linux ЦНЬЈЩЯЕФЗжЩЂЪНДЂДцЯЕЭГЃЌЭЈГЃгУгкИпПЩгУадЃЈhigh availability, HAЃЉМЏШКжаЁЃDRBD РрЫЦДХХЬеѓСаЕФRAID 1ЃЈОЕЯёЃЉЃЌжЛВЛЙ§ RAID 1 ЪЧдкЭЌвЛЬЈЕчФдФкЃЌЖј DRBD ЪЧЭИЙ§ЭјТчЁЃ

Ъ§ОнДцДЂЕФМИжжРраЭЃК

1.1ДцДЂЕФИХФюгыЪѕгя 1.1.3 DAS НщЩм DAS ЪЧжБСЌЪНДцДЂЃЈDirect-Attached Storage)ЕФМђГЦЃЌЪЧжИНЋДцДЂЩшБИЭЈЙ§SCSIНгПк ЛђЙтЯЫЭЈЕРжБНгСЌНгЕНвЛЬЈМЦЫуЛњЩЯЁЃЕБЗўЮёЦїдкЕиРэЩЯБШНЯЗжЩЂЃЌКмФбЭЈЙ§дЖГЬНјааЛЅСЌ ЪБЃЌDASЪЧБШНЯКУЕФНтОіЗНАИЁЃЕЋЪЧетжжЪНДцДЂжЛФмЭЈЙ§гыжЎСЌНгЕФжїЛњНјааЗУЮЪЃЌВЛФмЪЕЯжЪ§ОнгыЦфЫћжїЛњЕФЙВЯэЃЌЭЌЪБЃЌDASЛсеМгУЗўЮёЦїВйзїЯЕЭГзЪдДЃЌ Р§ШчCPUзЪдДЁЂIOзЪ дДЕШЃЌВЂЧвЪ§ОнжУдНДѓЃЌеМгУВйзїЯЕЭГзЪдДОЭдНбЯжиЁЃ NASЃК(Network Attach Srorage)ЭјТчИНМгДцДЂЃЌЫќ ОЭЪЧИіЮФМўЗўЮёЦїЃЌЪЧЮФМўЯЕЭГМЖБ№ЃЌNASКЭДЋЭГЕФЮФМўДцДЂЗўЮёЛђжБНгДцДЂЩшБИВЛЭЌЕФЕиЗНдкгкNASЩшБИЩЯУцЕФВйзїЯЕЭГКЭШэМўжЛЬсЙЉСЫЪ§ОнДцДЂЁЂЪ§ОнЗУ ЮЪЁЂвдМАЯрЙиЕФЙмРэЙІФмЃЛДЫЭтЃЌNASЩшБИвВЬсЙЉСЫВЛжЙвЛжжЮФМўДЋЪфавщЁЃNASЯЕЭГЭЈГЃгавЛИівдЩЯЕФгВХЬЃЌЖјЧвКЭДЋЭГЕФЮФМўЗўЮёЦївЛбљЃЌЭЈГЃЛсАбЫќУЧзщ ГЩRAIDРДЬсЙЉЗўЮёЃЛгаСЫNASвдКѓЃЌЭјТчЩЯЕФЦфЫћЗўЮёЦїОЭПЩвдВЛБидйМцШЮЮФМўЗўЮёЦїЕФЙІФмЁЃNASЕФаЭЪНКмЖрбљЛЏЃЌПЩвдЪЧвЛИіДѓСПЩњВњЕФЧЖШыЪНЩшБИЃЌ вВПЩвддквЛАуЕФМЦЫуЛњЩЯдЫааNASЕФШэМўЁЃ

NASгУЕФЪЧвдЮФМўЮЊЕЅЮЛЕФЭЈаХавщЃЌР§ШчЯёЪЧNFSЃЈдкUNIXЯЕЭГЩЯКмГЃМћЃЉЛђЪЧSMBЃЈГЃ гУгкWindowsЯЕЭГЃЉЁЃNASЫљгУЕФЪЧвдЮФМўЮЊЕЅЮЛЕФЭЈаХавщЃЌДѓМвЖМКмЧхГўЫќУЧЕФдЫзїФЃЪНЃЌЯрЖджЎЯТЃЌДцДЂЧјгђЭјТчЃЈSANЃЉгУЕФдђЪЧвдЧјПщЮЊЕЅЮЛ ЕФЭЈаХавщЁЂЭЈГЃЪЧЭЈЙ§SCSIдйзЊЮЊЙтЯЫЭЈЕРЛђЪЧiSCSIЁЃЃЈЛЙгаЦфЫћИїжжВЛЭЌЕФSANЭЈаХавщЃЌЯёЪЧATA over EthernetКЭHyperSCSIЃЌВЛЙ§етаЉЖМВЛГЃМћЁЃЃЉ

DRBDдкдЖГЬДЋЪфЩЯжЇГжШ§жжФЃЪНЃК ЙйЗНЬсЙЉЕФDRBDЕФЙЄзїСїГЬЭМЃК

ЕквЛВНЃКХфжУСНИіНкЕуЩЯЕФЫЋЛњЛЅаХЃЌетВНЮвЧАУцЕФВЉЮФжавбОаДЕНЙ§СЫЃЌПЩвдВЮЪ§ЧАУцЕФВЉЮФЃКCentOS 6.5 heartbeatИпПЩгУМЏШКЕФЯъНтЪЕЯжвдМАЙЄзїСїГЬЃЛ

ЕкЖўВНЃКАВзАDRBDГЬађАќЃЌетвЛВНвЛЖЈвЊИёЭтзЂвтАцБОЦЅХфЮЪЬтЃК

ФкКЫФЃПщГЬађАќвЛЖЈвЊИњФуЕФЯЕЭГФкКЫБЃГжвЛжТЃЌuname -rВщПДФуЕФФкКЫАцБОЃЌФкКЫФЃПщЕФАцБОБиаывЊбЯИёЖдгІЃЌЖјгУЛЇПеМфЕФФЃПщОЭВЛФЧУДбЯИёвЊЧѓСЫЃЌСНИіНкЕуЕФЪБМфвВашвЊБЃГжвЛжТадЃЛ

# yum -y install drbd-8.4.3-33.el6.x86_64.rpm drbd-kmdl-2.6.32-431.el6-8.4.3-33.el6.x86_64.rpm УПИіНкЕуЖМашвЊАВзАЩЯетСНИіГЬађАќ АВзАЭъГЩПЩвдПДвЛЯТdrbdЕФХфжУЮФМўЃК # vim /etc/drbd.conf жїХфжУЮФМў # vim /etc/drbd.d/global_common.conf ШЋОжКЭcommonЕФХфжУ global { #ШЋОжХфжУ usage-count no; #етИіЮЊyesБэЪОШчЙћФуБОЛњПЩвдСЌНгЛЅСЊЭјЪБdrbdЛсЭЈЙ§ЛЅСЊЭјЪеМЏЕНФуАВзАdrbdЕФаХЯЂЃЌЙйЗНЭГМЦЫЕгжЖрСЫвЛИіШЫЪЙгУdrbdЪЕР§ЃЌВЛгУПЩвдИФЮЊno # minor-count dialog-refresh disable-ip-verification } common { handlers { #ДІРэЦї # These are EXAMPLE handlers only. # They may have severe implications, # like hard resetting the node under certain circumstances. # Be careful when chosing your poison. pri-on-incon-degr "/usr/lib/drbd/notify-pri-on-incon-degr.sh; /usr/lib/drbd/notify-emergency-reboot.sh; echo b > /proc/sysrq-trigger ; reboot -f"; ЖЈвхСЫШчЙћжїНкЕуНЕМЖСЫдѕУДДІРэЕФ pri-lost-after-sb "/usr/lib/drbd/notify-pri-lost-after-sb.sh; /usr/lib/drbd/notify-emergency-reboot.sh; echo b > /proc/sysrq-trigger ; reboot -f"; етИіЖЈвхСЫШчЙћгаФдСбСЫжЎКѓевВЛЕНжїНкЕудѕУДДІРэЕФ local-io-error "/usr/lib/drbd/notify-io-error.sh; /usr/lib/drbd/notify-emergency-shutdown.sh; echo o > /proc/sysrq-trigger ; halt -f"; ЖЈвхСЫвЛЕЉБОЕиНкЕуЗЂЩњIOДэЮѓЪБгІИУдѕУДДІРэ # fence-peer "/usr/lib/drbd/crm-fence-peer.sh"; # split-brain "/usr/lib/drbd/notify-split-brain.sh root"; # out-of-sync "/usr/lib/drbd/notify-out-of-sync.sh root"; # before-resync-target "/usr/lib/drbd/snapshot-resync-target-lvm.sh -p 15 -- -c 16k"; # after-resync-target /usr/lib/drbd/unsnapshot-resync-target-lvm.sh; } startup { ЖЈвхвЛИіНкЕуЦєЖЏЪБСэвЛИіНкЕугІИУдѕУДзі # wfc-timeout(ЕШД§СэвЛИіНкЕуЩЯЯпЕФГЌЪБЪБГЄ) # degr-wfc-timeout(ЕШД§ГЌЪБКѓзіНЕМЖДІРэ) # outdated-wfc-timeout(Й§ЦкЕФЕШД§ГЌЪБ) # wait-after-sb(ФдСбжЎКѓЕШД§ЖрГЄЪБГЄ) } options { # cpu-mask on-no-data-accessible } disk { on-io-error detach; # size max-bio-bvecs on-io-error fencing disk-barrier disk-flushes # disk-drain md-flushes resync-rate resync-after al-extents # c-plan-ahead c-delay-target c-fill-target c-max-rate # c-min-rate disk-timeout } net { protocol C; cram-hmac-alg "sha1"; shared-secret "drbd.tanxw.com"; # protocol timeout max-epoch-size max-buffers unplug-watermark # connect-int ping-int sndbuf-size rcvbuf-size ko-count # allow-two-primaries cram-hmac-alg shared-secret after-sb-0pri # after-sb-1pri after-sb-2pri always-asbp rr-conflict # ping-timeout data-integrity-alg tcp-cork on-congestion # congestion-fill congestion-extents csums-alg verify-alg # use-rle } syncer { rate 1000M; } }

БЃДцЭЫГіЁЃ [root@node2 drbd.d]# fdisk /dev/sda WARNING: DOS-compatible mode is deprecated. It's strongly recommended to switch off the mode (command 'c') and change display units to sectors (command 'u'). Command (m for help): p Disk /dev/sda: 85.9 GB, 85899345920 bytes 255 heads, 63 sectors/track, 10443 cylinders Units = cylinders of 16065 * 512 = 8225280 bytes Sector size (logical/physical): 512 bytes / 512 bytes I/O size (minimum/optimal): 512 bytes / 512 bytes Disk identifier: 0x000e89e2 Device Boot Start End Blocks Id System /dev/sda1 * 1 26 204800 83 Linux Partition 1 does not end on cylinder boundary. /dev/sda2 26 7859 62914560 8e Linux LVM /dev/sda3 7859 9164 10489446 8e Linux LVM Command (m for help): n Command action e extended p primary partition (1-4) e Selected partition 4 First cylinder (9165-10443, default 9165): Using default value 9165 Last cylinder, +cylinders or +size{K,M,G} (9165-10443, default 10443): Using default value 10443 Command (m for help): n First cylinder (9165-10443, default 9165): Using default value 9165 Last cylinder, +cylinders or +size{K,M,G} (9165-10443, default 10443): +3G Command (m for help): p Disk /dev/sda: 85.9 GB, 85899345920 bytes 255 heads, 63 sectors/track, 10443 cylinders Units = cylinders of 16065 * 512 = 8225280 bytes Sector size (logical/physical): 512 bytes / 512 bytes I/O size (minimum/optimal): 512 bytes / 512 bytes Disk identifier: 0x000e89e2 Device Boot Start End Blocks Id System /dev/sda1 * 1 26 204800 83 Linux Partition 1 does not end on cylinder boundary. /dev/sda2 26 7859 62914560 8e Linux LVM /dev/sda3 7859 9164 10489446 8e Linux LVM /dev/sda4 9165 10443 10273567+ 5 Extended /dev/sda5 9165 9557 3156741 83 Linux Command (m for help): w The partition table has been altered! Calling ioctl() to re-read partition table. WARNING: Re-reading the partition table failed with error 16: Device or resource busy. The kernel still uses the old table. The new table will be used at the next reboot or after you run partprobe(8) or kpartx(8) Syncing disks. [root@node2 drbd.d]# kpartx -af /dev/sda device-mapper: reload ioctl on sda1 failed: Invalid argument create/reload failed on sda1 device-mapper: reload ioctl on sda2 failed: Invalid argument create/reload failed on sda2 device-mapper: reload ioctl on sda3 failed: Invalid argument create/reload failed on sda3 device-mapper: reload ioctl on sda4 failed: Invalid argument create/reload failed on sda4 device-mapper: reload ioctl on sda5 failed: Invalid argument create/reload failed on sda5 [root@node2 drbd.d]# partx -a /dev/sda BLKPG: Device or resource busy error adding partition 1 BLKPG: Device or resource busy error adding partition 2 BLKPG: Device or resource busy error adding partition 3 [root@node2 drbd.d]# partx -a /dev/sda BLKPG: Device or resource busy error adding partition 1 BLKPG: Device or resource busy error adding partition 2 BLKPG: Device or resource busy error adding partition 3 BLKPG: Device or resource busy error adding partition 4 BLKPG: Device or resource busy error adding partition 5 [root@node2 drbd.d]#

ЕкЫФВНЃКИљОнЩЯУцЕФУшЪіЃЌЮвУЧвЊИјЫќЖЈвхзЪдДЃЌАќРЈзЪдДУћЃЌdrbdЩшБИЃЌdiskвдМАЭјТчЪєадЃЌжївЊЪЧетЫФИіЗНУцЃЛ # cd /etc/drbd.d/ # vim mystore.res resource mystore { #ЖЈвхвЛИізЪдДЃЌгУЙиМќзжresourceЃЛ on node1.tanxw.com { #onЫЕУїдкФФИіНкЕуЩЯЃЌИњuname -nБЃГжвЛжТ,гаЖрЩйИіНкЕуОЭЖЈвхЖрЩйИіЃЛ device /dev/drbd0; #дкДХХЬЩЯБэЯжЕФdrbdНаЪВУДУћЃЛ disk /dev/sda5; #ЫљЪЙгУЕФДХХЬЩшБИЪЧФФИіЃЛ address 172.16.27.1:7789; #дкnode1етИіНкЕуЩЯМрЬ§ЕФЬзНгзж,ФЌШЯМрЬ§дк7789ЖЫПкЩЯЃЛ meta-disk internal; #БЃДцdrbdдЊЪ§ОнаХЯЂЕФЃЌБэЪООЭЗХдкздМКЕФДХХЬЧјЗжЩЯЃЌвВПЩвдЗХдкЭтВПЕФДХХЬЩЯЃЛ } on node2.tanxw.com { device /dev/drbd0; disk /dev/sda5; address 172.16.27.2:7789; meta-disk internal; } } БЃДцЭЫГіЃЌИДжЦвЛЗнЕНБ№вЛИіНкЕуЩЯЃЌЫќУЧЕФХфжУЮФМўвЊБЃГжвЛжТЃК # scp global_common.conf mystore.res node2.tanxw.com:/etc/drbd.d/ # drdbadm create-md mystore дкИїздЕФНкЕуЩЯГѕЪМЛЏзЪдД # server drbd start ЦєЖЏdrbd # watch -n 1 'cat /proc/drbd' ЪЕЯжВщПДДХХЬаХЯЂ # drbdadm primary --force mystore дкНкЕуЩЯАбЦфжавЛИіЬсЩ§ЮЊжїЕФ # watch -n 1 'cat /proc/drbd' ЬсЩ§ЮЊжїЕФжЎКѓдйЪЕЯжВщПДДХХЬаХЯЂ зЂвтЃКФФИіЪЧжїНкЕуФФИіОЭПЩвдЙвдиЪЙгУЃЌВЛЪЧжїНкЕуЕФСЌЙвдиЖМВЛПЩвдЙвдиЃЛ OKЁЂПДЕНСНИіНкЕуЩЯЕФЪ§Оне§дкЭЌВНСЫЃЌДХХЬдНДѓЭЌВНЪБашвЊЪБМфдНОУЃЛ

ЕкЮхВНЃКдкЦфжавЛИіНкЕуЩЯНјааИёЪНЛЏЃК # scp global_common.conf mystore.res node2.tanxw.com:/etc/drbd.d/ # drdbadm create-md mystore дкИїздЕФНкЕуЩЯГѕЪМЛЏзЪдД # server drbd start ЦєЖЏdrbd # watch -n 1 'cat /proc/drbd' ЪЕЯжВщПДДХХЬаХЯЂ # drbdadm primary --force mystore дкНкЕуЩЯАбЦфжавЛИіЬсЩ§ЮЊжїЕФ # watch -n 1 'cat /proc/drbd' ЬсЩ§ЮЊжїЕФжЎКѓдйЪЕЯжВщПДДХХЬаХЯЂ КУСЫЃЌЕНетРяОЭЭъГЩЕФdrbdЕФЙЄзїФЃЪНОЭетУДЫГРћЕФЭъГЩСЫЃЌЮвВЛжЊЕРЮвЪЧЗёЫЕУїАзСЫЃЁ

вЊЭъГЩdrbdЕФНЧЩЋздЖЏЧаЛЛЕУвЊНшжњгкcorosync+pacmakerЃЌФЧНгЯТРДЮвУЧОЭРДАВзАХфжУcorosyncКЭpacemakerАЩЃЛ ЮЊСЫШУИпПЩгУЕФХфжУЫГРћЃЌСНИіНкЕуЖМВЛФмЩшжУЮЊжїЕФЃЌЖјЧвЖМВЛФмЦєЖЏЃЌвВВЛФмПЊЛњздЖЏЦєЖЏЃЌЫљвдаЖдиНЕМЖЃК # cd # umount /dev/drbd0 # drbdadm secondary mystore ФФИіЪЧжїЕФОЭдкФФЯрНкЕуЩЯНЕМЖ # service drbd stop СНИіНкЕуЖМашвЊЭЃжЙЗўЮё # chkconfig drbd off ЕкСљВНЃКАВзАcorosync + pacemakerЃЌетРяжБНггУyumРДАВзАЃЌСНИіНкЕуЖМвЊАВзАЩЯЃЛ # yum -y install corosync pacemaker # yum -y install crmsh pssh # cp /etc/corosync.conf.example /etc/corosync/corosync.conf # vim /etc/corosync/corosync.conf compatibility: whitetank totem { version: 2 secauth: on threads: 0 interface { ringnumber: 0 bindnetaddr: 172.16.0.0 mcastaddr: 226.98.188.188 mcastport: 5405 ttl: 1 } } logging { fileline: off to_stderr: no to_logfile: yes to_syslog: no logfile: /var/log/cluster/corosync.log debug: off timestamp: on logger_subsys { subsys: AMF debug: off } } amf { mode: disabled } service { name: pacemaker ver: 0 } aisexce { user: root group: root } # mv /dev/random /dev/m # ln /dev/urandom /dev/random ШчЙћетАбетИіЫцЛњЪ§ЩЪГиИФСЫПЩвдЛсВњЩњЫцЛњЪ§ВЛЙЛгУЃЌетИіОЭвЊЧУЛїМќХЬИјетИіЩЪГивЛаЉЫцЛњЪ§ЃЛЩњГЩЭъетИіkeyКѓАбСДНгЩОГ§ЃЌдйАбЩЪГиИФЛиРДЃЛВЛЙ§етбљИФПЩвдЛсгаЕуЮЊАВШЋЃЌВЛЙ§зіВтЪдЕФгІИУВЛвЊНєЃЛ # corosync-keygen # rm -rf /dev/random # mv /dev/m /dev/random дйАбИФКУЕФХфжУИДжЦвЛЗнЕНБ№вЛИіНкЕуЩЯШЅЃЌвВБЃСєвЛЗнИјСэвЛИіНкЕуЃК # scp -p authkey corosync.conf node2.tanxw.com:/etc/corosync/ ЦєЖЏCorosyncЃЌУПИіНкЕуЖМашвЊЦєЖЏЃЛ

ЕкЦпВНЃКНгЯТРДНјШыcrmУќСюааНгПкЖЈвхзЪдДЃК # crm status ВщПДНкЕуЕФдЫаазДЬЌ # crm # configure # property stonith-enabled=false # property no-quorum-policy=ignore # rsc_defaults resource-stickiness=100 # verify # commit # show # meta ocf:linbit:drbd ВщПДdrbdЕФЯъЯИаХЯЂ # ЖЈвхзЪдД,ЧаЛЛЕНconfigureжаЃЌmysqlstoreЖЈвхзЪдДУћЃЌdrbd_resource=mystoreетИіЪЧdrbdУћЃЌКѓУцЖЈвхЕФЖМЪЧвЛаЉМрПи # primitive mysqlstore ocf:linbit:drbd params drbd_resource=mystore op monitor role=Master interval=30s timeout=20s op monitor role=Slave interval=60s timeout=20s op start timeout=240s op stop timeout=100s # verify МьВщгяЗЈ # ЖЈвхжїзЪдД # master ms_mysqlstore mysqlstore meta master-max=1 master-node-max=1 clone-max=2 clone-node-max=1 notify=”True” # verify #commit ЖЈвхЙВЯэЮФМўЕФзЪдД,ВЂЧвШУЗўЮёЦїЧаЛЛЪБПЩвдздЖЏЙвдиЃЌdevice=/dev/drbd0ЙвдиЕФЩшБИЃЌdirectory=/drbdЙвдиЕуЃЌСНИіЙвдиЕуЕФЮФМўУћвЊвЛжТЃК # primitive mysqlfs ocf:heartbeat:Filesystem params device=/dev/drbd0 directory=/drbd fstype=ext4 op monitor interval=30s timeout=40s on-fail-restart op start timeout=60s op stop timeout=60s # verify ЖЈвхХХСадМЪјЃК # collocation mysqlfs_with_ms_mysqlstore_master inf: mysqlfs ms_mysqlstore:Master # verify ЖЈвхЫГађдМЪјЃК # order mysqlfs_after_ms_mysqlstore_master mandatory: ms_mysqlstore:promote mysqlfs:start # show # commit

OKЃЌдйВщПДвЛЯТЫќУЧЯждкЕФзДЬЌЃЌnode2ЪЧжїЕФЃЌЖјnode1ЪЧДгЕФЃЌПЩвдЕНnode2ЩЯВщПДЮФМўЪЧЗёвбОЙвдиЩЯШЅЕФЃЌбщжЄвЛЯТЃЌдйДДНЈЛђаоИФМИИіЮФМўНјШЅЖМПЩвдзівЛЯТВтЪдЕФЃЌЖјКѓдйШУnode2ЭЃЕєЃЌПДПДnode1ЪЧЗёЛсздЖЏЧаЛЛЮЊжїЕФЃК

ИФБфНкЕуЕФжїДгЮЛжУЃК

crm(live)# node standby node2.tanxw.com Абnode2ЬсЩ§ЮЊБИгУЕФ

crm(live)# node noline node2.tanxw.com ШУnode2ЩЯЯп

crm(live)# node standby node1.tanxw.com Абnode1ЬсЩ§ЮЊБИгУЕФ

crm(live)# node noline node1.tanxw.com ШУnode1ЩЯЯпЃЌЖМПЩвдЫцвтЧаЛЛвЛЯТдйМьВтвЛЯТЙвдиЕФаЇЙћЕФЃЛ

(д№ШЮБрМЃКIT) |