|

1 hadoop中各工程包依赖简述

Google的核心竞争技术是它的计算平台。Google的大牛们用了下面5篇文章,介绍了它们的计算设施。

GoogleCluster: http://research.google.com/archive/googlecluster.html

Chubby:http://labs.google.com/papers/chubby.html

GFS:http://labs.google.com/papers/gfs.html

BigTable:http://labs.google.com/papers/bigtable.html

MapReduce:http://labs.google.com/papers/mapreduce.html

很快,Apache上就出现了一个类似的解决方案,目前它们都属于Apache的Hadoop项目,对应的分别是:

Chubby-->ZooKeeper

GFS-->HDFS

BigTable-->HBase

MapReduce-->Hadoop

目前,基于类似思想的Open Source项目还很多,如Facebook用于用户分析的Hive。

HDFS作为一个分布式文件系统,是所有这些项目的基础。分析好HDFS,有利于了解其他系统。由于Hadoop的HDFS和MapReduce是同一个项目,我们就把他们放在一块,进行分析。

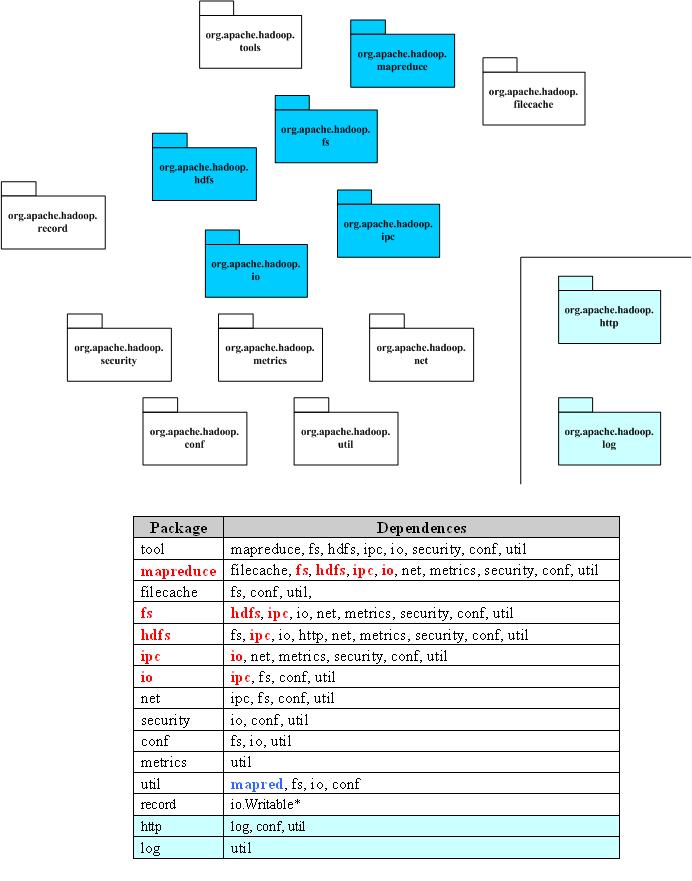

Hadoop包之间的依赖关系比较复杂,原因是HDFS提供了一个分布式文件系统, 该系统提供API,可以屏蔽本地文件系统和分布式文件系统,甚至象Amazon S3这样的在线存储系统。这就造成了分布式文件系统的实现,或者是分布式 文件系统的底层的实现,依赖于某些貌似高层的功能。功能的相互引用,造成了蜘蛛网型的依赖关系。一个典型的例子就是包conf,conf用于读取系统配 置,它依赖于fs,主要是读取配置文件的时候,需要使用文件系统,而部分的文件系统的功能,在包fs中被抽象了。

2 hadoop工程中各工程包依赖图示

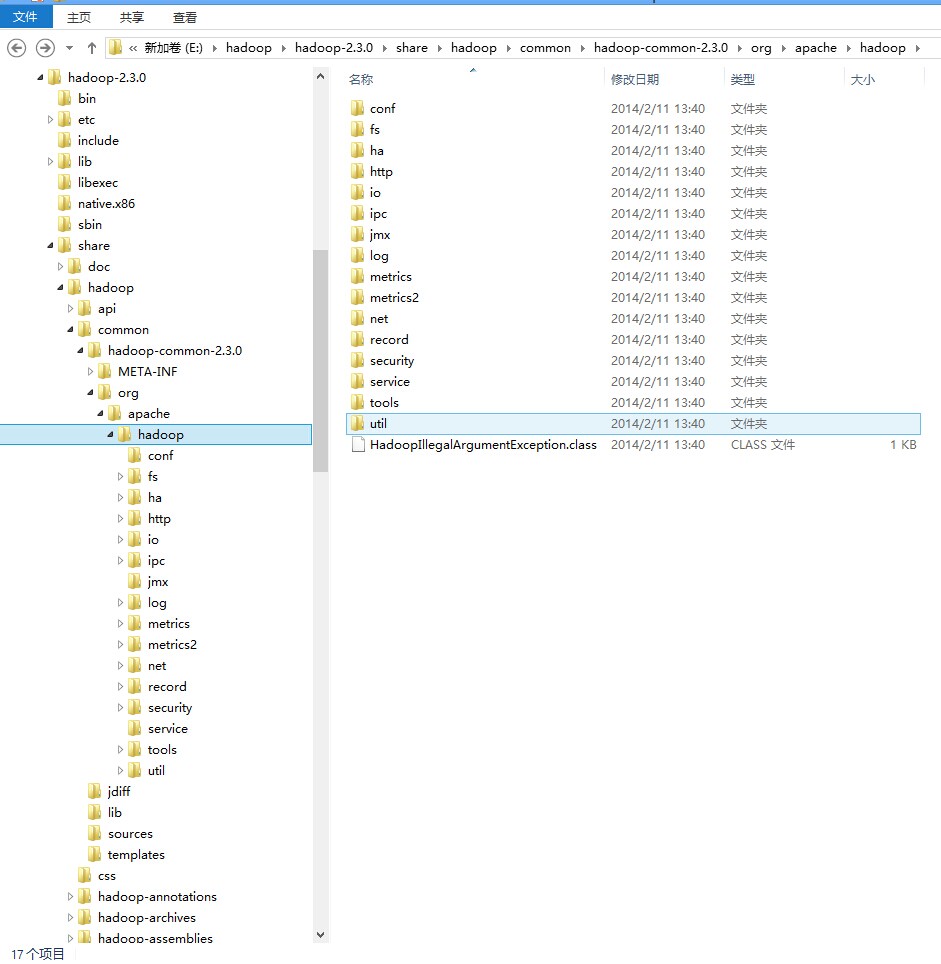

3 hadoop工程中各工程包文件夹图示(可点击图片查看大图)

其中,各包功能如下:

|

Package

|

Dependences

|

|

tool

|

提供一些命令行工具,如DistCp,archive

|

|

mapreduce

|

Hadoop的Map/Reduce实现

|

|

filecache

|

提供HDFS文件的本地缓存,用于加快Map/Reduce的数据访问速度

|

|

fs

|

文件系统的抽象,可以理解为支持多种文件系统实现的统一文件访问接口

|

|

hdfs

|

HDFS,Hadoop的分布式文件系统实现

|

|

ipc

|

一个简单的IPC的实现,依赖于io提供的编解码功能

参考:http://zhangyu8374.iteye.com/blog/86306

|

|

io

|

表示层。将各种数据编码/解码,方便于在网络上传输

|

|

net

|

封装部分网络功能,如DNS,socket

|

|

security

|

用户和用户组信息

|

|

conf

|

系统的配置参数

|

|

metrics

|

系统统计数据的收集,属于网管范畴

|

|

util

|

工具类

|

|

record

|

根据DDL(数据描述语言)自动生成他们的编解码函数,目前可以提供C++和Java

|

|

http

|

基于Jetty的HTTP Servlet,用户通过浏览器可以观察文件系统的一些状态信息和日志

|

|

log

|

提供HTTP访问日志的HTTP Servlet

|

参考文件:http://blog.csdn.net/xiaogugood/article/details/8209839

(责任编辑:IT) |