|

前言:

提交Hadoop作业时我们遇到了许多的问题,在网上也查过许多的文章,有许多对hadoop提交作业原理进行分析的文章,却总看不到对具体操作过程讲解的文章,导致我们在eclipse提交的作业总是在eclipse虚拟的云环境中运行。慢慢摸索中,一个一个的作业提交方法被我们发现,呵呵,现在总结一下吧。

方案:

1、用命令行方式提交

2、在eclipse中提交作业

3、采用eclipse的插件实现项目的提交

方案一:用命令行方式提交

前提:成功搭建一个hadoop集群,或成功部署一个伪分布式,并启动hadoop。

提交过程:

1、在eclipse中将我们的项目打成一个jar包,放到hadoop的安装目录下。

2、在命令行中提交作业,这里以hadoop自带的wordcount程序为例:

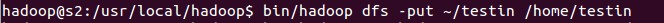

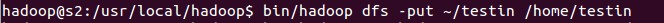

(1)将统计文件传到hdfs,如图(1)

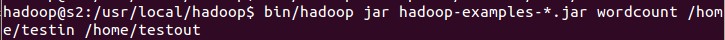

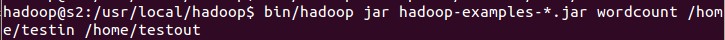

(2)向云提交作业,如图(2)

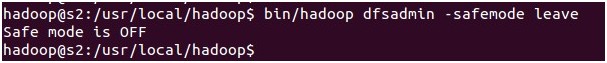

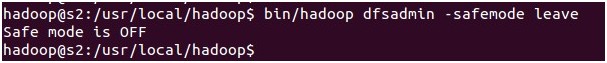

提交作业时,如果遇到错误:Name node in safe mode,可采用下面的解决方法,如图(3)

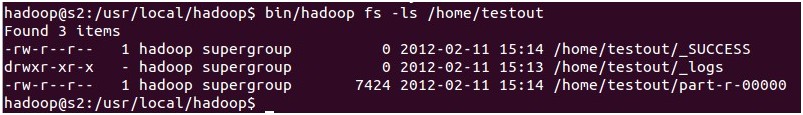

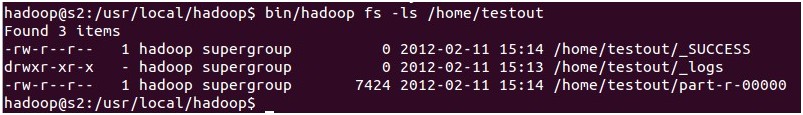

(3)列出hdfs上输出文件夹下的文件,如图(4)

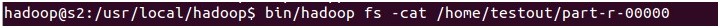

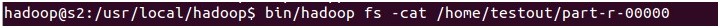

(4)在命令行中打印统计好的结果,如图(5)

(注:在命令行中提交作业是按hadoop/conf下的配置文件提交的)

方案二:在eclipse中提交作业

前提:

1、在你的电脑上安装好eclipse,可以在linux下,也可以在windows环境下哦~,这里需要指出的是:提交作业的机器只要有Hadoop的API就可以了,和提交作业的机器所处的环境无关。

2、成功搭建一个hadoop集群,或成功部署一个伪分布式,并启动hadoop。

提交过程:

1、在eclipse下建立一个mapreduce项目,导入hadoop的API(hadoop/lib下的包)。

这里直接从外部导入hadoop中自带的wordcount程序。为了可以直接“Run java Aplication”我修改了一点wordcount的代码,使其输入输出文件的地址直接在代码中设置。贴出代码如下:

wordcount.java:

-

package org.apache.hadoop.examples;

-

-

import java.io.IOException;

-

import java.util.StringTokenizer;

-

import org.apache.hadoop.conf.Configuration;

-

import org.apache.hadoop.fs.Path;

-

import org.apache.hadoop.io.IntWritable;

-

import org.apache.hadoop.io.Text;

-

import org.apache.hadoop.mapreduce.Job;

-

import org.apache.hadoop.mapreduce.Mapper;

-

import org.apache.hadoop.mapreduce.Reducer;

-

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

-

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

-

-

public class WordCount {

-

-

public static class TokenizerMapper

-

extends Mapper<Object, Text, Text, IntWritable>{

-

-

private final static IntWritable one = new IntWritable(1);

-

private Text word = new Text();

-

-

public void map(Object key, Text value, Context context

-

) throws IOException, InterruptedException {

-

StringTokenizer itr = new StringTokenizer(value.toString());

-

while (itr.hasMoreTokens()) {

-

word.set(itr.nextToken());

-

context.write(word, one);

-

}

-

}

-

}

-

-

-

public static class IntSumReducer

-

extends Reducer<Text,IntWritable,Text,IntWritable> {

-

private IntWritable result = new IntWritable();

-

-

public void reduce(Text key, Iterable<IntWritable> values,

-

Context context

-

) throws IOException, InterruptedException {

-

int sum = 0;

-

for (IntWritable val : values) {

-

sum += val.get();

-

}

-

result.set(sum);

-

context.write(key, result);

-

}

-

}

-

public static void main(String[] args) throws Exception {

-

Configuration conf = new Configuration();

-

-

Job job = new Job(conf, "word count");

-

job.setJarByClass(WordCount.class);

-

job.setMapperClass(TokenizerMapper.class);

-

job.setCombinerClass(IntSumReducer.class);

-

job.setReducerClass(IntSumReducer.class);

-

job.setOutputKeyClass(Text.class);

-

job.setOutputValueClass(IntWritable.class);

-

FileInputFormat.addInputPath(job, new Path("/home/hadoop/testin"));

-

FileOutputFormat.setOutputPath(job, new Path("/home/hadoop/testout"));

-

-

System.exit(job.waitForCompletion(true) ? 0 : 1);

-

-

}

-

}

-

如果此时你run java aplication,呵呵,你的程序只会在eclipse中虚拟的一个云环境中运行,而不会跑上云端去运行哦。我们一帮人在这个问题上纠结了好长时间。如果你想在云端运行,需要在main方法中添加几行代码,代码附录如下:

-

-

conf.set("fs.default.name", "hdfs://master:9000/");

-

conf.set("Hadoop.job.user","xiaolu");

-

-

conf.set("mapred.job.tracker","master:9001");

(注:如果你运行的不是master上也有的项目,比如自己实现的pagerank,那会报错如下:)

-

java.lang.RuntimeException: java.lang.ClassNotFoundException: *.PRMapper

这时会报找不到Mapper类的错。呵呵,这个问题也卡了我们好长时间。我们分析:可能是没有将项目打包,导致云上没有mapreduce程序的缘故,我们尝试着将pagerank项目打成.jar文件,放在项目下,将main方法作出如下修改:

-

-

JobConf conf = new JobConf();

-

-

conf.setJar("pagerank.jar");

这时运行java aplication ,呵呵,结果我们成功地将作业提交到了云端。(在浏览器中浏览:master:50030)

方案三:采用eclipse的插件实现项目的提交

前提:在eclipse中成功地安装mapreduce插件。

不过需要提醒各位的是:Hadoop-0.20.203.0版本自带的插件不够完整,需要作出如下修改:

1、将HADOOP_HOME/lib目录下的 commons-configuration-1.6.jar , commons-httpclient-3.0.1.jar , commons-lang-2.4.jar , jackson-core-asl-1.0.1.jar 和 jackson-mapper-asl-1.0.1.jar 等5个包复制到hadoop-eclipse-plugin-0.20.203.0.jar的lib目录下。

2、然后,修改该包META-INF目录下的MANIFEST.MF,将classpath修改为以下内容:

-

Bundle-ClassPath: classes/,lib/hadoop-core.jar,lib/commons-cli-1.2.jar,lib/commons-httpclient-3.0.1.jar,lib/jackson-core-asl-1.0.1.jar,lib/jackson-mapper-asl-1.0.1.jar,lib/commons-configuration-1.6.jar,lib/commons-lang-2.4.jar

(注:这样就完成了对hadoop-eclipse-plugin-0.20.203.0.jar的修改。如果还有其它的问题,比如Map/Reduce Locations下添加一个Location不能弹出添加对话框,这是eclipse版本的问题,我建议大家采用eclipse的版本是:eclipse-java-indigo-SR1-linux-gtk.tar.gz。)

提交过程:

1、不用手动将项目打成jar包,run on Hadoop就OK了。呵呵~

(责任编辑:IT) |