-

Hive 打开调试模式

日期:编程过程中发现错误,无法看到具体的错误信息,网上搜了下,按照下面的方法启动Hive Shell就可以打开调试(注意:此方法只对本次回话有效): hive --hiveconf hive.root.logger=DEBUG,console 如果需要对所有会话有效,则可以修改Hive的配置文件。不过不建...

-

Apache Hadoop下一代MapReduce框架(YARN)简介 (Apache Hadoop NextGen MapReduce (YARN))

日期:英文看着头大,先试着翻译一下。 E文原文: http://archive.cloudera.com/cdh5/cdh/5/hadoop/hadoop-yarn/hadoop-yarn-site/YARN.html 翻译真是太难了,而且我翻译的好烂,好烂,有时候自己也只能理解个大概。 ====================================begin===...

-

MyEclipse开发hadoop时报org.apache.hadoop.security.AccessControlException: Permission denied:

日期:用MyEclipse开发hadoop时报org.apache.hadoop.security.AccessControlException: Permission denied: 停止hadoop测试环境: [hadoop@icity0bin]$./stop-all.sh Warning:$HADOOP_HOMEisdeprecated. stoppingjobtracker icity1:stoppingtasktracker icity2:sto...

-

hadoop hdfs java api操作实战

日期:hadoop java api操作实战: 公共方法: staticfinalStringPATH=hdfs://icity0:9000/; privatestaticFileSystemgetFileSystem()throwsIOException,URISyntaxException{ FileSystemfileSystem=FileSystem.get(newURI(PATH),newConfiguration()); returnfileSys...

-

hadoop shell 操作指南

日期:hadoop shell 操作指南 FS Shell 调用文件系统(FS)Shell命令应使用bin/hadoop fs args的形式。 所有的的FS shell命令使用URI路径作为参数。URI格式是scheme://authority/path。对HDFS文件系统,scheme是hdfs,对本地文件系统,scheme是file。其中scheme和aut...

-

hadoop1.1.2分布式环境搭建

日期:hadoop1.1.2分布式安装 Hadoop简介 Hadoop是Apache软件基金会旗下的一个开源分布式计算平台。以Hadoop分布式文件系统(HDFS,Hadoop Distributed Filesystem)和MapReduce(Google MapReduce的开源实现)为核心的Hadoop为用户提供了系统底层细节透明的分布式...

-

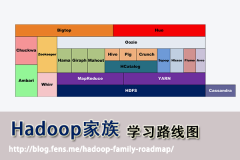

Hadoop家族学习路线图

日期:Hadoop家族系列文章 ,主要介绍Hadoop家族产品,常用的项目包括Hadoop, Hive, Pig, HBase, Sqoop, Mahout, Zookeeper, Avro, Ambari, Chukwa,新增加的项目包括,YARN, Hcatalog, Oozie, Cassandra, Hama, Whirr, Flume, Bigtop, Crunch, Hue等。 从2011年开...

-

使用配置Hadoop中常用的Linux(Ubuntu)命令

日期:使用配置Hadoop中常用的linux(Ubuntu)命令 生成key: $ ssh-keygen -t dsa -P -f ~/.ssh/id_dsa $ cat ~/.ssh/id_dsa.pub ~/.ssh/authorized_keys -t 密钥类型可以用 -t 选项指定。如果没有指定则默认生成用于SSH-2的RSA密钥。 -f filename 指定密钥文件名。...

-

Hadoop在Map阶段获取当前split的文件名

日期:在mapper处理阶段中有时候我们需要获取当前正在处理的HDFS文件名/HDFS目录名,其实我们可以通过 Context 来获取相关参数,代码类似如下: 1 2 3 4 5 FileSplit fileSplit = (FileSplit) context.getInputSplit(); System.out.println(======== getPath.getNa...

-

hadoop多硬盘配置注意点

日期:[一]、实验环境 1.1、环境 hadoop 2.6.0 namenode 2个 各增加 2个1T硬盘 datanode 3个 各增加3个1T硬盘 1.2、挂载硬盘 fdisk 分区 (输入mnp1回车回车pw) mkfs 格式化硬盘 ( mkfs.ext4 ) mount 挂载硬盘 (以挂载目录为 /bigdata/data0 /bigdata/data1 . /bigd...